激光雷达、相机…万字长文带你入门无人驾驶车硬件( 八 )

第二种是采用芯片厂家推出的无人驾驶计算平台 , 比如英伟达的 DRIVE、德州仪器基于 DSP 的 TDA2X Soc、恩智浦的 BlueBox 。 这类平台都是采用开发板设计 , 不太适合直接应用在无人驾驶中 , 好处是厂家提供了 SDK , 可以做到开箱即用 。

文章插图

文章插图

图 2.13 Navidia drive AGX

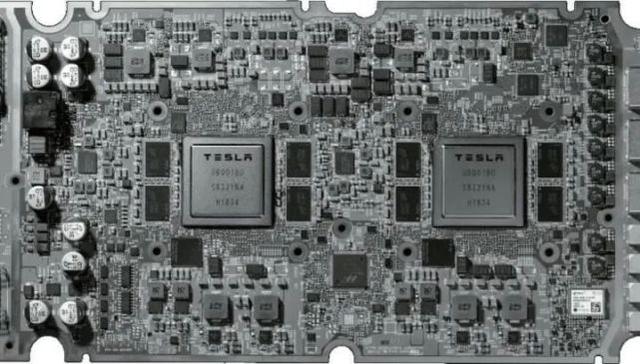

第三种是自研计算平台 。 特斯拉的 FSD 就是自研的计算平台 , 集成度非常高 , 采用冗余设计 , 集成有专门的安全模块 , 性能和接口也能够满足特定场景的要求 。 自研芯片的解决方案非常适合无人驾驶 , 但是研发成本太高 。

文章插图

文章插图

图 2.14 特斯拉 FSD 芯片

2.4.4 边缘计算

边缘计算是无人驾驶未来的发展趋势之一 , 传感器中会逐步集成融合和滤波算法 , 而不需要把所有的计算全都放在计算平台中完成 。 典型的应用场景是为了处理摄像头拍摄的大量图像 , 可以先用 FPGA 处理 , 然后输出处理好的结果给计算平台使用 , 这样不仅可以减轻系统带宽压力 , 同时还可以加快图片处理速度 。

2.5 辅助单元

除了实现无人驾驶必须的一些硬件之外 , 我们还需要一些硬件来辅助无人驾驶 , 无人驾驶车没有司机 , 因此需要人机交互设备实现人和车的交互 。 此外 , 无人驾驶车同外界进行通讯 , 还需要 V2X 等网络设备 。 最后无人驾驶车还需要类似飞机黑匣子的设备来记录无人车的状态 , 在发生交通事故之后 , 帮助分析事故原因 。

【激光雷达、相机…万字长文带你入门无人驾驶车硬件】2.5.1 人机交互

1. 为什么需要人机交互?

无人驾驶车带来的好处显而易见 , 汽车不再需要司机了 , 带来的后果是 , 我们从和司机交流变成和汽车交互了 。 司机能够很好的理解乘客的意图 , 同时也能对突发状况进行处理 , 以目前的技术而言无人驾驶车还远达不到这么先进 。 未来人机交互正朝着更加智能的方向发展 , 以便更好的理解人的意图 。

2. 人机交互的过程

人机交互分为 2 个过程:一是人对车下达指令 , 二是车对人的反馈 。 如图 2.15 所示 。

文章插图

文章插图

图 2.15 人机交互过程

人对车下达指令最直接的需求就是告诉汽车 , 我要从哪里上车 , 目的地是哪里 。 这是出行最本质的需求 , 目前的无人驾驶打车服务 , 提供的还是点对点的服务 , 也就是说你无法选择起点和终点 , 只能选择固定线路 , 真正的无人驾驶服务应该提供任意点到点的服务 。 通过滴滴打车时 , 我们可能不止一次因为手机定位不准 , 需要打电话给司机沟通上车地点 。 而无人驾驶车没有司机 , 如果乘客的定位不准 , 那么如何和无人车确认上车地点就成了问题 , 因此解决人和车的沟通问题在无人驾驶打车中显得尤为重要 。

未来 , 人对车的指令会由单纯的机械指令变的更加抽象 , 只需要指定一系列行为 , 无人驾驶车会自动完成这一过程 , 现在已经实现的功能就有自适应巡航和自动泊车等 。

车对人的反馈包括通知乘客无人驾驶车当前的状态、位置、速度以及电池的电量等 。 同时人机交互系统还需要提示是否发现了潜在的威胁 , 以及车准备做出的决策 , 乘客凭借这些信息能够知道驾驶过程是否安全 。 如果无人驾驶车出现了故障 , 人机交互系统还需要发出警报提醒乘客 。

文章插图

文章插图

图 2.16 特斯拉 model3 交互界面

除了功能上的交互 , 还需要关注车载服务的交互 。 自动驾驶普及之后 , 车不仅仅是作为交通工具 , 更像是一个私密场所了 , 人们可以在车内办公、娱乐、游戏和休息 。 车内的娱乐和影音服务都会升级 , 乘车可能变得更有乐趣而言了 。

推荐阅读

- 小米有品众筹激光鼻炎治疗仪:不吃药 不开刀

- 新荣耀新旗舰V40海报露出 屏幕和相机是最大特色

- OPPO Reno4 Pro 5G的DXO相机评分出炉!拿到108分

- 曝iPhone 13全系标配激光雷达扫描仪 真就十三香?

- Galaxy S21系列相机规格曝光:Ultra配1.08亿像素主摄

- 谷歌相机最新版移植来了!新增电影运镜

- 设计总监谈小米11外形:后摄方案百里挑一、多花2000万定制相机模组

- 小米10i手机参数曝光!专供印度市场后置相机大升级

- 一加Nord智能机DxOMark相机得分108:表现中等 性价比尚可

- 佳能新专利曝光 或将推出云台相机