|жұӮжұӮдҪ 们еҲ«з”ЁиҝҷдәӣжҠҖжңҜжҗһй»„иүІе•Ұ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

ж–Үз« еӣҫзүҮ

йҡҸзқҖ AI жҠҖжңҜзҡ„еҸ‘еұ• пјҢ ж— дёӯз”ҹжңүиҝҷ件дәӢеҜ№дәҺеӨ§е®¶жқҘиҜҙ пјҢ е·Із»Ҹи¶ҠжқҘи¶Ҡе®№жҳ“дәҶ гҖӮз®ҖеҚ•дёҖзӮ№зҡ„ пјҢ е°ұеғҸеҫҲеӨҡдәәжүӢжңәйҮҢйғҪжңүзҡ„ AI зҫҺйўңдёҖж · гҖӮйҖҡиҝҮдәәи„ёжЈҖжөӢ пјҢ иҮӘеҠЁиҜҶеҲ«и„ёйғЁзү№еҫҒзӮ№ пјҢ 然еҗҺйҖҡиҝҮ AI еҢ–еҰҶгҖҒж·»еҠ ж»Өй•ң пјҢ иҫҫеҲ°й”ҰдёҠж·»иҠұзҡ„ж•Ҳжһң гҖӮжңәе“ҘзӣёдҝЎиҝҷдәӣзҺ©жі• пјҢ еӨ§е®¶йғҪе·Із»ҸйқһеёёзҶҹжӮү гҖӮдҪҶжҳҜеҡҜ пјҢ AI иғҪеҒҡзҡ„е…¶е®һиҝңиҝңдёҚжӯўиҝҷдәӣ гҖӮеҲ’йҮҚзӮ№ пјҢе®ғиҝҳиғҪеӨҹйҖҡиҝҮз®—жі•иҮӘеҠЁжӣҙжҚўз”»йқўйҮҢзҡ„е…ғзҙ гҖӮд»Җд№Ҳж„ҸжҖқе‘ўпјҹе…¶е®һиҝҷдәӢиҜҙиө·жқҘ并дёҚйҡҫзҗҶи§Ј пјҢ е°ұжҳҜзұ»дјјеӨ§е®¶иҖізҶҹиғҪиҜҰзҡ„жҠ еӣҫжҠҖжңҜ гҖӮеҸӘдёҚиҝҮеңЁ AI зҡ„еҠ жҢҒд№ӢдёӢ пјҢ иҝҷдёҖеҲҮйғҪеҸҜд»ҘйҖҡиҝҮзЁӢеәҸиҮӘеҠЁе®ҢжҲҗ пјҢ иҖҢдёҚйңҖиҰҒеғҸд»ҘеҫҖдёҖж · пјҢ еңЁз”өи„‘еүҚдёҖзӮ№дёҖзӮ№ең°зІҫз»ҶеӨ„зҗҶ гҖӮ

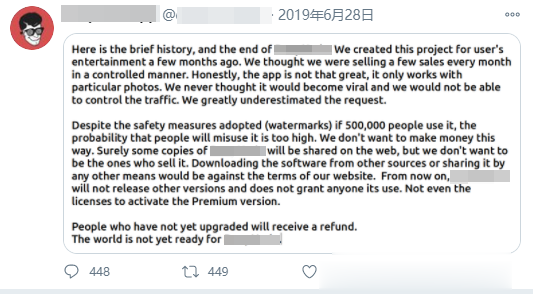

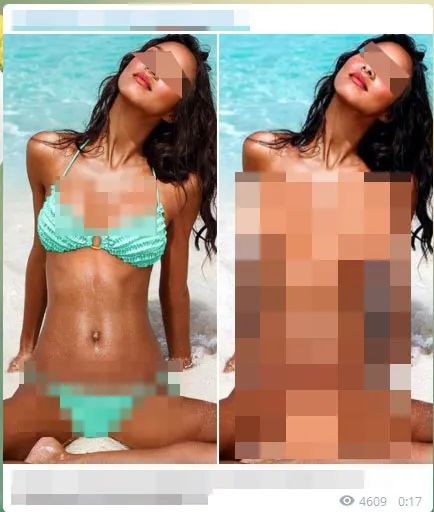

дҫӢеҰӮеӨ§е®¶зҶҹжӮүзҡ„ AI жҚўи„ё гҖӮжңәе“Ҙд№ӢеүҚз»ҷжңәеҸӢ们д»Ӣз»ҚиҝҮ пјҢ B з«ҷдёҠе°ұжңүеҫҲеӨҡзұ»дјјзҡ„и§Ҷйў‘ пјҢ еғҸжҳҜжҠҠеҗҙеҪҰзҘ–зҡ„и„ёжҚўеҲ°иӢҸеӨ§ејәзҡ„иә«дёҠ гҖӮи®Ізңҹ пјҢ зҡ„зЎ®жҳҜжҜ«ж— иҝқе’Ң гҖӮеҗҺжқҘзҡ„дәӢжғ… пјҢ еӨ§е®¶д№ҹзҹҘйҒ“е•Ұ гҖӮиҝҷйЎ№жҠҖжңҜиў«дёҚе°‘дәәз”ЁеңЁжӯӘи·ҜеӯҗдёҠ пјҢ е°ұжҳҜе°ҶеҲ«дәәзҡ„и„ёжҚўеңЁдәҶxxи§Ҷйў‘дёҠжҗһй»„иүІ пјҢ еҢ…жӢ¬еӨ§е®¶зҶҹжӮүзҡ„жҳҺжҳҹ гҖӮдәҺжҳҜеҗ„еӨ§е№іеҸ°дҫҝзә·зә·ејҖе§Ӣ пјҢ жүјеҲ¶иҝҷз§Қж»Ҙз”Ё AI иҝӣиЎҢйқһиҮӘж„ҝжҚўи„ёзҡ„иЎҢдёә гҖӮдёҚиҝҮдёҮдёҮжІЎжғіеҲ°вҖҰжңҖиҝ‘зұ»дјјзҡ„ AI жҗһй»„иүІиҪҜ件еҚ·еңҹйҮҚжқҘ гҖӮжңәе“Ҙд»ҠеӨ©жғіиҜҙзҡ„жҳҜ пјҢ е°ұжҳҜеҸҰеӨ–дёҖж¬ҫйҖҡиҝҮAI жҠҖжңҜ пјҢ е®һзҺ° дёҖй”®и„ұжҺүиЎЈжңҚ ж•Ҳжһңзҡ„иҪҜ件 гҖӮжңәеҸӢ们еҸҜиғҪеҜ№иҝҷдёӘ AI зЁӢеәҸдёҚеӨӘдәҶи§Ј пјҢ жңәе“ҘжҠұзқҖжҷ®еҸҠзҹҘиҜҶзҡ„еҝғжҖҒ пјҢ е…Ҳз®ҖеҚ•з»ҷеӨ§е®¶д»Ӣз»ҚдёҖдёӢ гҖӮиҝҷдёӘзЁӢеәҸеҹәдәҺеҠ е·һеӨ§еӯҰдјҜе…ӢеҲ©еҲҶж Ўз ”з©¶иҖ…ејҖеҸ‘зҡ„ејҖжәҗз®—жі• pix2pix еҲӣе»ә пјҢ дҪҝз”Ё 1 дёҮеј xxеӣҫзүҮеҠ д»Ҙи®ӯз»ғ гҖӮеҸӘиҰҒдёҠдј зү№е®ҡзҡ„з…§зүҮ пјҢ зЁӢеәҸе°ұиғҪеҖҹеҠ©зҘһз»ҸзҪ‘з»ңжҠҖжңҜ пјҢ еҲҶиҫЁеҮәз…§зүҮзҡ„зү№еҫҒзӮ№ гҖӮ然еҗҺ пјҢ иҝҷдёӘзЁӢеәҸеҸҜд»Ҙе°ҶиЎЈжңҚиҰҶзӣ–зҡ„иә«дҪ“йғЁдҪҚ пјҢ иҮӘеҠЁжӣҝжҚўжҲҗжҜ«ж— йҒ®жҺ©зҡ„ж•Ҳжһң пјҢ дёҖеј и¶ід»ҘйӘ—иҝҮеӨ§еӨҡж•°дәәзҡ„з§ҒеҜҶз…§е°ұжӯӨиҜһз”ҹ гҖӮжңүеӢҮж•ўзҡ„еӣҪеӨ–з”ЁжҲ· пјҢ дҪҝз”ЁиҮӘе·ұзҡ„з…§зүҮеҜ№иҝҷдёӘзЁӢеәҸиҝӣиЎҢдәҶжөӢиҜ• гҖӮиҝҷдёӘе°Ҹе§җе§җдёҠдј дәҶдёҖеј иҮӘе·ұиә«з©ҝжііиЎЈзҡ„з…§зүҮ гҖӮ иҷҪ然照зүҮйҮҢзҡ„еҘ№йңІеҮәдәҶиҮӘе·ұзҡ„иә«жқҗ пјҢ дҪҶзӣёеҜ№жқҘиҜҙиҝҳжҳҜжҜ”иҫғеҒҘеә·зҡ„з©ҝзқҖ гҖӮдҪҶз»ҸиҝҮзЁӢеәҸиҝҷд№ҲдёҖеӨ„зҗҶ пјҢ дёҚд»…е°Ҹе§җе§җз…§зүҮдёҠзҡ„иЎЈжңҚдёҚи§ҒдәҶ пјҢ зЁӢеәҸиҝҳз»ҷеҘ№жҚўдёҠеҺҹжң¬дёҚеұһдәҺеҘ№зҡ„иә«дҪ“йғЁдҪҚ гҖӮд»Һз»ҶиҠӮдёҠзңӢ пјҢ еӨ„зҗҶж•ҲжһңйқһеёёйҖјзңҹ гҖӮ жҜ”иө·д»ҘеҫҖ移иҠұжҺҘжңЁзҡ„ Photoshop еҒҮз…§зүҮ пјҢ з®ҖзӣҙжҳҜиғҪеӨҹд»ҘеҒҮд№ұзңҹ гҖӮиҷҪ然иҝҷдёӘзЁӢеәҸеҸӘжңүеңЁз…§зүҮйҮҢзҡ„дәәзү©з©ҝзқҖжҜ”иҫғжё…еҮүзҡ„ж—¶еҖҷ пјҢ жүҚиғҪиҫҫеҲ°иҝҷз§Қж•Ҳжһң пјҢдҪҶ жғ…еҶөиҝҳжҳҜдёҖдёӢеӯҗ е°ұеҸҳеҫ—дёҖеҸ‘дёҚ еҸҜ收жӢҫгҖӮдёәе•Ҙе‘ўпјҹеҢ…жӢ¬жҳҺжҳҹеңЁеҶ…зҡ„еҫҲеӨҡз”ЁжҲ· пјҢ йғҪжӣҫз»ҸеңЁзӨҫдәӨе№іеҸ°дёҠеҲҶдә«иҝҮзӣёеҗҢзұ»еһӢзҡ„з…§зүҮ пјҢ з”ҡиҮіжңүдёҖйғЁеҲҶе·Із»Ҹиў«жңүеҝғдәәеЈ«еҒҡжҲҗxxеӣҫзүҮ пјҢ еңЁдә’иҒ”зҪ‘дёҠејҖе§ӢжөҒдј гҖӮеҚідҫҝиҝҷдәӣз…§зүҮжҳҜеҒҮзҡ„ пјҢ дҪҶиҝҳжҳҜдёҖе®ҡзЁӢеәҰдёҠеҜ№еҘ№д»¬йҖ жҲҗе·ЁеӨ§зҡ„еҪұе“Қ гҖӮдәҺжҳҜ пјҢ еңЁ еҜҹи§үеҲ° иў«ж»Ҙз”Ёд№ӢеҗҺпјҢ ејҖеҸ‘иҖ…еҫҲеҝ«е°ұе®Јеёғе…ій—ӯиҝҷдёӘзҪ‘з«ҷеҸҠзЁӢеәҸ гҖӮ

пјҲејҖеҸ‘иҖ…еңЁзӨҫдәӨеӘ’дҪ“е®Јеёғе…іеҒңпјүдҪҶжҳҜеҲ«еҝҳдәҶ пјҢ дә’иҒ”зҪ‘并没жңүз§ҳеҜҶ гҖӮз”ұдәҺиҝҷдёӘзЁӢеәҸзҡ„ејҖеҸ‘иҖ…жӣҫ з»Ҹе°Ҷд»Јз Ғ пјҢ дёҠдј еҲ°ејҖжәҗзҪ‘з«ҷ пјҢ жүҖд»ҘзҠҜзҪӘеҲҶеӯҗеҫҲеҝ«е°ұе°ҶиҝҷдёӘзЁӢеәҸдҪңдёә他们зҡ„дҪңжЎҲе·Ҙе…· гҖӮжңүжҠҖжңҜз ”з©¶дәәе‘ҳйҖҡиҝҮи°ғжҹҘиЎЁзӨә пјҢ иҝҷдёӘзЁӢеәҸзҺ°еңЁе·Із»Ҹиў«еҶ…зҪ®еңЁеӣҪеӨ– жҹҗдёӘApp дёҠгҖӮ

пјҲеӘ’дҪ“жҸӯйңІиҝҷдёӘ App еҪ“дёӯзҡ„зЁӢеәҸиҝҗдҪңпјүжҢүз…§жҠҖжңҜдәәе‘ҳзҡ„иҜҙжі• пјҢ еңЁиҝҷдёӘ App еҪ“дёӯ пјҢ еҸӘиҰҒеҠ е…Ҙзү№е®ҡзҡ„зҫӨз»„ пјҢ е°ұиғҪиҝӣиЎҢдёҖй”®и„ұиЎЈ гҖӮзӣ®еүҚ пјҢ е·Із»Ҹжңүи¶…иҝҮ 68 дёҮеҗҚеҘіжҖ§з”ЁжҲ·зҡ„з…§зүҮ пјҢ иў«дёҠдј еҲ°иҝҷдёӘ App дёҠ пјҢ 并且еңЁжңӘз»Ҹе…¶зҹҘжғ…жҲ–еҗҢж„Ҹзҡ„жғ…еҶөдёӢ пјҢ еҸҳжҲҗйӮЈз§ҚжЁЎжӢҹ*дҪ“з…§зүҮ гҖӮиҖҢиҝҷдәӣз…§зүҮ пјҢ иҝҳеңЁжҹҗдәӣзҫӨз»„еҪ“дёӯжөҒдј гҖӮдёәдәҶдёҖжҺўз©¶з«ҹ пјҢ жңәе“ҘдёӢиҪҪдәҶиҝҷдёӘ App пјҢ дёәеӨ§е®¶дәІиә«дҪ“йӘҢдёӢиҝҷдёӘеҚ·еңҹйҮҚжқҘзҡ„еҠҹиғҪ гҖӮиҙ№дәҶдёҖз•ӘеҠҹеӨ« пјҢ жңәе“Ҙз»ҲдәҺеҠ иҝӣеҺ»еҮ дёӘзұ»дјјзҫӨз»„ гҖӮ

еңЁиҝҷдёӘзҫӨз»„еҪ“дёӯ пјҢ еҮ д№ҺжүҖжңүзҡ„ж¶ҲжҒҜйғҪжҳҜпјҡдҪҝз”ЁиҝҷдёӘзЁӢеәҸеҲ¶йҖ еҮәжқҘзҡ„еҒҮз…§зүҮ гҖӮ

д»”з»ҶзңӢиҝҳиғҪеҸ‘зҺ° пјҢ еҮ д№ҺжҜҸдёҖеј з…§зүҮ пјҢ йғҪеҗёеј•дәҶеҮ еҚғдәәзҡ„и§ӮзңӢ гҖӮ

жңәе“Ҙзһ„дәҶдёҖзңј пјҢ иҝҷдәӣзӨәиҢғзҡ„з…§зүҮйҷӨдәҶдё“дёҡзҡ„жЁЎзү№жііиЈ…з…§зүҮд№ӢеӨ– пјҢ иҝҳжңүд»ҺеҲ«дәәзӨҫдәӨзҪ‘з»ңдёҠжҠ“еҸ–зҡ„иҮӘжӢҚз…§ гҖӮиҜ•жғідёҖдёӢ пјҢ еҰӮжһңзў°е·§еңЁиҝҷйҮҢзңӢеҲ°зҶҹдәәзҡ„*дҪ“з…§ пјҢ иҷҪ然жҳҜ AI еҲ¶йҖ еҮәжқҘзҡ„еҒҮз…§зүҮ пјҢ йӮЈд№ҹжҳҜзӣёеҪ“е°ҙе°¬ гҖӮ

йӮЈд№Ҳ пјҢ иҝҷдәӣеҒҮ*дҪ“з…§жҳҜжҖҺд№ҲеҲ¶дҪңеҮәжқҘзҡ„е‘ўпјҹ

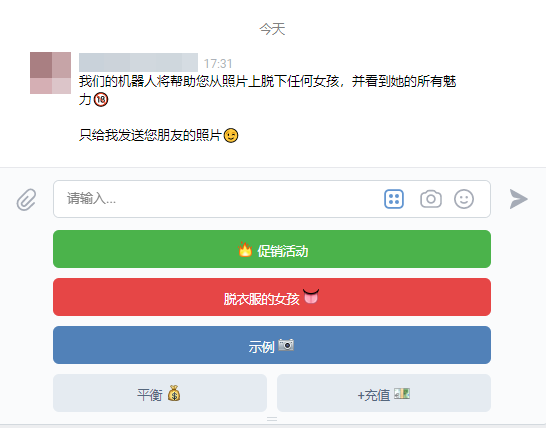

иҝҷдәӣз…§зүҮзҡ„дёӢж–№ пјҢ жңүй“ҫжҺҘиғҪзӣҙжҺҘи·іиҪ¬еҲ°жҹҗдёӘе°ҸзЁӢеәҸ гҖӮеңЁиҝҷйҮҢ пјҢ ејҖеҸ‘иҖ…з”ҡиҮіиҝҳдјҡдәІеҲҮең°её®з”ЁжҲ·жҢҮеј• пјҢ е‘ҠиҜүз”ЁжҲ·е“Әдәӣз…§зүҮжүҚиғҪиҺ·еҫ—жӣҙеҘҪзҡ„ AI и„ұиЎЈж•Ҳжһң гҖӮ

жҢүз…§зі»з»ҹзҡ„жҢҮзӨә пјҢ еҸӘиҰҒеҸ‘йҖҒеҗҲж јзҡ„з…§зүҮ пјҢ е°ұиғҪиҺ·еҫ—зӣёеә”зҡ„еҒҮ*дҪ“з…§ гҖӮдәҺжҳҜжңәе“ҘжҠұзқҖеё®еӨ§е®¶жҸӯејҖиҝҷдёӘзЁӢеәҸзңҹйқўзӣ®зҡ„еҝғжғ…е°қиҜ•дәҶдёҖдёӢ пјҢ еҸ‘зҺ°вҖҰвҖҰиҝҷеұ…然иҝҳжҳҜ收иҙ№зҡ„ гҖӮж №жҚ®жҲҗзүҮзҡ„и§„ж ј пјҢ иҝҳжңүдёҚдёҖж ·зҡ„收иҙ№ пјҢ д»Һдәәж°‘еёҒ 4 е…ғеҲ° 100 е…ғдёҚзӯү гҖӮиҖҢд»ҳж¬ҫд№ӢеҗҺ пјҢ з”ЁжҲ·е°ұе°ҶеңЁеҜ№иҜқжЎҶдёӯ收еҲ°иҝҷеј еҒҮ*дҪ“з…§ гҖӮ

жңәе“ҘдҪ“йӘҢдәҶеҮ дёӘзҫӨз»„дёӢжқҘ пјҢ еӨ§жҰӮйғҪжҳҜиҝҷж ·зҡ„ж“ҚдҪң гҖӮжңүзҡ„ејҖеҸ‘иҖ…иҝҳдјҡи®ҫзҪ®е…ій”®еӯ— пјҢ зЎ®е®ҡдҪ зҡ„е№ҙйҫ„жҳҜеҗҰиҫҫеҲ°еҸҜд»ҘжөҸи§Ҳзҡ„зЁӢеәҰ пјҢ иҝҳжҢәиҙҙеҝғ гҖӮдёҚиҝҮи®ҪеҲәзҡ„жҳҜ пјҢ ж №жҚ®жҠҖжңҜз ” 究дәәе‘ҳзҡ„и°ғжҹҘжҠҘе‘ҠжҳҫзӨә пјҢ иҝҷйҮҢйқўзҡ„йғЁеҲҶеҸ—е®іиҖ… пјҢ жң¬иә«е°ұжҳҜжңӘжҲҗе№ҙдәә гҖӮжҢүз…§и°ғжҹҘдәәе‘ҳзҡ„иҜҙжі• пјҢ з”ҡиҮіжңүйғЁеҲҶзҫӨз»„ йқ вҖңжңӘжҲҗе№ҙдәәвҖқзҡ„еҷұеӨҙ пјҢ иҺ·еҫ—дёҚ少收е…Ҙ гҖӮ

иҝҷ并дёҚжҳҜиҝҷдёӘ AI зЁӢеәҸ第дёҖж¬Ўиў«з”ЁеҲ°зҠҜзҪӘжҙ»еҠЁдёӯ гҖӮеңЁеҸҰеӨ–дёҖдёӘеӣҪеӨ–зҡ„зӨҫдәӨе№іеҸ°дёҠ пјҢ иҝҷдёӘи„ұиЎЈзЁӢеәҸд№ҹеҗҢж ·жіӣж»Ҙ гҖӮ жңәе“ҘйҡҸжүӢдёҖжҗң пјҢ е°ұеҸ‘зҺ°еӨ§йҮҸзұ»дјјзҡ„еҶ…е®№ гҖӮзңӢзңӢиҝҷдёӘж–ҮжЎҲ пјҢ еҶҷеҫ—жӣҙеҠ йңІйӘЁ гҖӮ

еңЁиҝҷдәӣе№ҝе‘ҠйҮҢ пјҢ 他们иҝҳзӣҙжҺҘеј•еҜјз”ЁжҲ·еҸ‘йҖҒжңӢеҸӢжҲ–еҗҢеӯҰзҡ„з…§зүҮ гҖӮеҸҜд»ҘиҜҙжҳҜйқһеёёиҝҮеҲҶе•Ұ гҖӮ

пјҲеҝҪз•ҘжёЈжёЈзҝ»иҜ‘пјү

иҖҒ规зҹ© пјҢ жңәе“Ҙе°қиҜ•дәҶдёҖдёӢ гҖӮиҝҷдәӣзӨҫдәӨе№іеҸ°дёҠзҡ„дёҖй”®и„ұиЎЈзЁӢеәҸ пјҢ и·ҹдёҠйқўйӮЈдәӣзҫӨз»„дёҖж · пјҢ йғҪжҳҜйҖҡиҝҮиҝҷз§Қж–№ејҸиҺ·еҫ—йқһ法收е…Ҙзҡ„ гҖӮ

е…¶е®һ пјҢ жӣҙж—©д№ӢеүҚзҡ„зӨҫдәӨиҪҜ件еҪ“дёӯ пјҢ е°ұеҮәзҺ°иҝҮзұ»дјјзҡ„иҜҲйӘ—иЎҢдёә гҖӮд»ҘеҫҖ пјҢ зҠҜзҪӘеҲҶеӯҗдјҡиҜұеҜјз”ЁжҲ·еҸ‘йҖҒиҮӘе·ұзҡ„зңҹ *дҪ“з…§пјҢ д»ҺиҖҢиҝӣиЎҢеӢ’зҙўпјӣдҪҶйҖҡиҝҮиҝҷдёӘзЁӢеәҸ пјҢ зҠҜзҪӘеҲҶеӯҗеҸӘйңҖиҰҒеҫ—еҲ°дёҖеј ж—Ҙеёёзҡ„з…§зүҮ пјҢ е°ұиғҪејҖе§ӢзҠҜзҪӘиЎҢдёә гҖӮдёҚд»…еҰӮжӯӨ пјҢ зҠҜзҪӘеҲҶеӯҗиҝҳиғҪйҖҡиҝҮжңЁй©¬иҺ·еҸ–з”ЁжҲ·зҡ„йҖҡи®ҜеҪ• пјҢ 并且дјҡз”ЁиҝҷдәӣеҒҮз…§зүҮ пјҢ еҜ№йҖҡи®ҜеҪ•еҪ“дёӯзҡ„дәІеҸӢиҝӣиЎҢеӢ’зҙў гҖӮиҝҷд№ҲдёҖжқҘ пјҢ иә«иҫ№жҜ«дёҚзҹҘжғ…зҡ„дәәе°ұдјҡеҮәдәҺйҳ»жӯў*дҪ“з…§дј ж’ӯзҡ„зӣ®зҡ„ пјҢ жғізҠҜзҪӘеҲҶеӯҗж”Ҝд»ҳжүҖи°“зҡ„вҖңиөҺйҮ‘вҖқ гҖӮдёҚеҫ—дёҚиҜҙ пјҢ е°ұиҝҷж ·дёҖдёӘ AI зЁӢеәҸ пјҢ еҸҜи°“жҳҜй—№еҫ—дәәеҝғжғ¶жғ¶ гҖӮз”ҡиҮіжңүдёҖдәӣеҘіжҖ§з”ЁжҲ·е·Із»ҸејҖе§Ӣ пјҢ жңүж„ҸеҮҸе°‘еңЁзӨҫдәӨе№іеҸ°дёҠеҸ‘з…§зүҮзҡ„йў‘зҺҮ гҖӮе°ұиҝһеүҚдёҚд№…еҚ°еәҰзҡ„дә’иҒ”зҪ‘з«ҷдёҠзҪ‘еҸӢеҸ‘иө·зҡ„вҖңзәұдёҪжҢ‘жҲҳвҖқ пјҢ йғҪиў«еӘ’дҪ“иӯҰе‘ҠеҸҜиғҪдјҡжңүйЈҺйҷ© гҖӮ

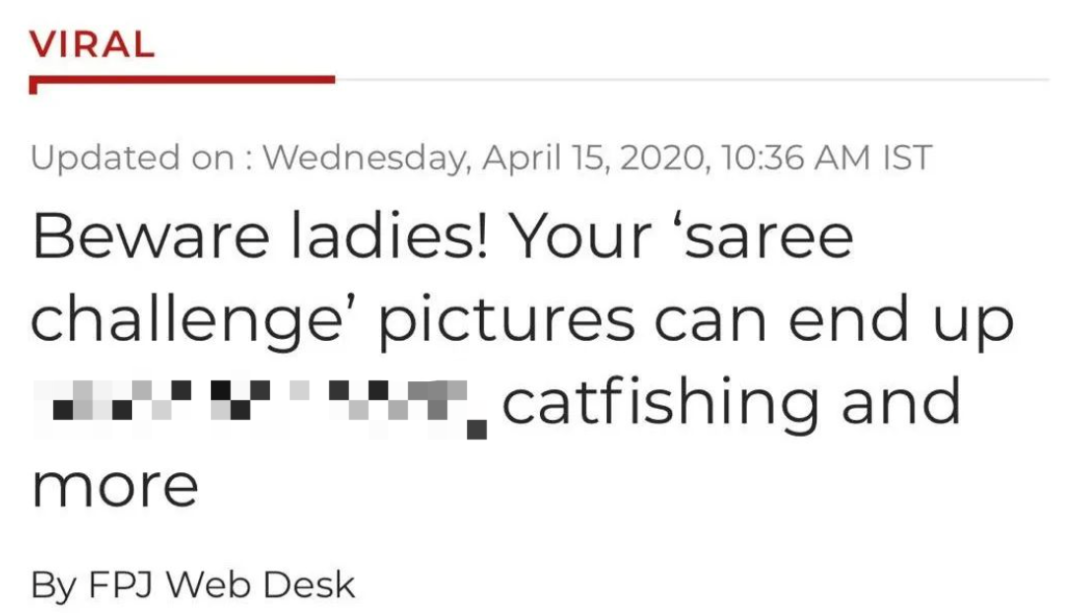

пјҲеҘіеЈ«д»¬е°Ҹеҝғ пјҢ дҪ зҡ„вҖңзәұдёҪжҢ‘жҲҳвҖқеӣҫзүҮеҸҜиғҪеҸҳжҲҗ*з…§пјү

жҢүз…§еӘ’дҪ“зҡ„иҜҙжі• пјҢ иҝҷдәӣеҘіеӯ©жҳҜиә«дёҠзҡ„ зәұдёҪ еңЁ пјҢ еңЁ дёҖй”®и„ұиЎЈзЁӢеәҸйқўеүҚ пјҢ з®ҖзӣҙдёҚеҖјдёҖжҸҗ гҖӮ

иҖҢдё” пјҢ иҝҷдёӘжҢ‘жҲҳжҙ»еҠЁиҝҳж¶үеҸҠдёӘдәәйҡҗз§Ғжі„йңІ гҖӮдёҖж—ҰеңЁжҢ‘жҲҳдёӯиүҫ зү№иҮӘе·ұзҡ„еҘҪеҸӢ пјҢ йӮЈд№Ҳе°ұзӣёеҪ“дәҺдёәзҠҜзҪӘеҲҶеӯҗжҸҗдҫӣеӢ’зҙўеҜ№иұЎ гҖӮжҪҳеӨҡжӢүйӯ”зӣ’иў«жү“ејҖ пјҢ йӮЈе°ұдёҚжҳҜйӮЈд№Ҳе®№жҳ“е°ұеҸҜд»Ҙе…ідёҠзҡ„ гҖӮзү№еҲ«жҳҜеҗ„з§Қеҗ„ж ·зҡ„ AI жҠҖжңҜ пјҢ иў«ж»Ҙз”Ёзҡ„еҗҺжһң пјҢ з®ҖзӣҙжҳҜз»ҶжҖқжҒҗжһҒ гҖӮеҪ“然 пјҢ еҗ„з§Қд»Һ AI жҠҖжңҜиЎҚз”ҹеҮәжқҘзҡ„зҠҜзҪӘиЎҢдёә пјҢ иҜҘжү“еҮ»иҝҳжҳҜеҫ—жү“еҮ» гҖӮдҪҶжӣҙйҮҚиҰҒзҡ„жҳҜ пјҢ еҰӮдҪ•д»Һж №жң¬дёҠи§ЈеҶіиҝҷдёӘй—®йўҳ гҖӮйқўеҜ№иҝҷдёӘдёҖй”®и„ұиЎЈзЁӢеәҸ пјҢ зӣ® еүҚиҝҳжІЎжңүдёҖдёӘе®ҢзҫҺзҡ„ж–№жі• пјҢ еӨ§жҰӮеҸӘиғҪеҜ„еёҢжңӣдәҺе…¶д»–ејҖеҸ‘иҖ… пјҢ иғҪејҖеҸ‘еҮәдёҖеҘ—и®©з…§зүҮж— жі•иў« AI иҜҶеҲ«зҡ„ж–№жі•е•Ұ гҖӮжңәе“ҘиҝҳжҳҜйӮЈеҸҘиҖҒиҜқпјҡжұӮжұӮдҪ 们еҲ«еҶҚз”Ёиҝҷдәӣ AI жҠҖжңҜжҗһй»„иүІдәҶе•ҠвҖҰвҖҰпјҲеӣҫзүҮжқҘжәҗиҮӘзҪ‘з»ңпјү

гҖҗ|жұӮжұӮдҪ 们еҲ«з”ЁиҝҷдәӣжҠҖжңҜжҗһй»„иүІе•ҰгҖ‘еҲ«ж»Ҙз”ЁжҠҖжңҜе•Ҡ

жҺЁиҚҗйҳ…иҜ»

- еҶіе®ҡз”ЁзҮ•йәҰзүҮжҗӯй…ҚдёҖдәӣйЈҹжқҗеҒҡдёҖж¬ҫеҸ‘зі•пјҢзңҹзҡ„жҳҜеӨӘжҡ„иҪҜдәҶпјҢжқҫиҪҜйҰҷз”ңжҜ”йқўеҢ…иҝҳеҘҪеҗғпјҢзҮ•йәҰзүҮдҪ 们йғҪе–ңж¬ўеҗғеҗ—

- йҰҷиҸҮдёҚиғҪе’ҢиҝҷдёӘдёңиҘҝдёҖиө·еҗғпјҢдҪ 们зҹҘйҒ“еҗ—

- зӮ–зүӣиӮүеҲ«з”Ёй«ҳеҺӢй”…,ж•ҷдҪ дёҖжӢӣ,зүӣиӮүиҪҜзғӮе…Ҙе‘і,дёҖзӮ№д№ҹдёҚеЎһзүҷ

- еҺЁзҘһиҜҙжјҸеҳҙдёҚз®ЎзӮ’д»Җд№ҲиӮүпјҢйғҪеҲ«з”Ёж·ҖзІүи…ҢеҲ¶пјҢзүўи®°3зӮ№пјҢйІңе«©е…Ҙе‘і

- зӮёе°ҸйұјеҲ«з”ЁйқўзІүдәҶпјҢжҚўжҲҗе®ғпјҢзүўи®°вҖң3жӯҘиө°вҖқпјҢдҝқиҜҒйҰҷй…Ҙе«©пјҢиҝҳе…Ҙе‘і

- иүҫеҸ¶зіҚзІ‘дҪ еҒҡеҜ№дәҶеҗ—пјҹеҲ«з”ЁеҶ·ж°ҙиҝҳжҳҜзғӯж°ҙе’ҢзІүйғҪеҲҶдёҚжё…е“ҹ

- еҒҡзғ§йҘјеҲ«з”Ёж°ҙпјҢиҝҷеҒҡжі•еӨӘйҰҷдәҶпјҢзҡ®й…ҘйҮҢиҪҜпјҢз©әеҸЈиғҪеҗғж’‘пјҢжҜ”йқўеҢ…йғҪйҰҷ

- иҸ иҗқ|иҸ иҗқеҲ«з”Ёзӣҗж°ҙжіЎпјҒи®©иҸ иҗқдёҚжүҺеҳҙжңҖеҘҪзҡ„ж–№жі•жҳҜиҝҷдёӘ

- еҮүжӢҢгҖҒзӮ’иҸңгҖҒжІ№зӮёпјҢеҲҶеҲ«з”Ёе“Әз§ҚжІ№жӣҙеҗҲйҖӮпјҹ

- еҒҡиҫЈжӨ’зӮ’иӮүпјҢеҲ«з”Ёж·ҖзІүи…ҢеҲ¶дәҶпјҢеӨ§еҺЁж•ҷдҪ еҒҡжі•пјҢиӮүзүҮж»‘е«©еҸҲе…Ҙе‘і