ELK е·Із»ҸжҲҗдёәзӣ®еүҚжңҖжөҒиЎҢзҡ„йӣҶдёӯејҸж—Ҙеҝ—и§ЈеҶіж–№жЎҲпјҢе®ғдё»иҰҒжҳҜз”ұBeatsгҖҒLogstashгҖҒElasticsearchгҖҒKibanaзӯү组件组жҲҗпјҢжқҘе…ұеҗҢе®ҢжҲҗе®һж—¶ж—Ҙеҝ—зҡ„收йӣҶ пјҢ еӯҳеӮЁпјҢеұ•зӨәзӯүдёҖз«ҷејҸзҡ„и§ЈеҶіж–№жЎҲ гҖӮжң¬ж–Үе°Ҷдјҡд»Ӣз»ҚELKеёёи§Ғзҡ„жһ¶жһ„д»ҘеҸҠзӣёе…ій—®йўҳи§ЈеҶі гҖӮ

- FilebeatпјҡFilebeatжҳҜдёҖж¬ҫиҪ»йҮҸзә§пјҢеҚ з”ЁжңҚеҠЎиө„жәҗйқһеёёе°‘зҡ„ж•°жҚ®ж”¶йӣҶеј•ж“Һ пјҢ е®ғжҳҜELK家ж—Ҹзҡ„ж–°жҲҗе‘ҳпјҢеҸҜд»Ҙд»ЈжӣҝLogstashдҪңдёәеңЁеә”з”ЁжңҚеҠЎеҷЁз«Ҝзҡ„ж—Ҙеҝ—收йӣҶеј•ж“ҺпјҢж”ҜжҢҒе°Ҷ收йӣҶеҲ°зҡ„ж•°жҚ®иҫ“еҮәеҲ°KafkaпјҢredisзӯүйҳҹеҲ— гҖӮ

- Logstashпјҡж•°жҚ®ж”¶йӣҶеј•ж“ҺпјҢзӣёиҫғдәҺFilebeatжҜ”иҫғйҮҚйҮҸзә§пјҢдҪҶе®ғйӣҶжҲҗдәҶеӨ§йҮҸзҡ„жҸ’件пјҢж”ҜжҢҒдё°еҜҢзҡ„ж•°жҚ®жәҗ收йӣҶпјҢеҜ№ж”¶йӣҶзҡ„ж•°жҚ®еҸҜд»ҘиҝҮж»ӨпјҢеҲҶжһҗпјҢж јејҸеҢ–ж—Ҙеҝ—ж јејҸ гҖӮ

- ElasticsearchпјҡеҲҶеёғејҸж•°жҚ®жҗңзҙўеј•ж“ҺпјҢеҹәдәҺApache Luceneе®һзҺ°пјҢеҸҜйӣҶзҫӨпјҢжҸҗдҫӣж•°жҚ®зҡ„йӣҶдёӯејҸеӯҳеӮЁпјҢеҲҶжһҗпјҢд»ҘеҸҠејәеӨ§зҡ„ж•°жҚ®жҗңзҙўе’ҢиҒҡеҗҲеҠҹиғҪ гҖӮ

- Kibanaпјҡж•°жҚ®зҡ„еҸҜи§ҶеҢ–е№іеҸ°пјҢйҖҡиҝҮиҜҘwebе№іеҸ°еҸҜд»Ҙе®һж—¶зҡ„жҹҘзңӢ Elasticsearch дёӯзҡ„зӣёе…іж•°жҚ®пјҢ并жҸҗдҫӣдәҶдё°еҜҢзҡ„еӣҫиЎЁз»ҹи®ЎеҠҹиғҪ гҖӮ

иҝҷз§Қжһ¶жһ„дёҚи¶ізҡ„жҳҜпјҡLogstashжҜ”иҫғиҖ—жңҚеҠЎеҷЁиө„жәҗпјҢжүҖд»ҘдјҡеўһеҠ еә”з”ЁжңҚеҠЎеҷЁз«Ҝзҡ„иҙҹиҪҪеҺӢеҠӣ гҖӮ

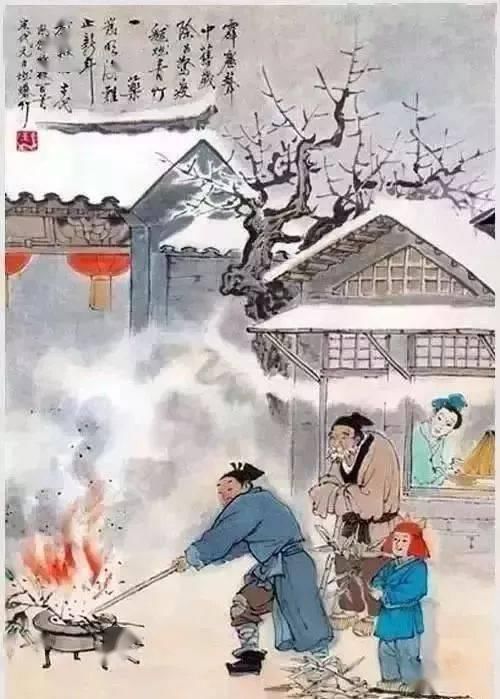

ж–Үз« жҸ’еӣҫ

2. FilebeatдҪңдёәж—Ҙеҝ—收йӣҶеҷЁиҜҘжһ¶жһ„дёҺ第дёҖз§Қжһ¶жһ„е”ҜдёҖдёҚеҗҢзҡ„жҳҜпјҡеә”з”Ёз«Ҝж—Ҙеҝ—收йӣҶеҷЁжҚўжҲҗдәҶFilebeatпјҢFilebeatиҪ»йҮҸпјҢеҚ з”ЁжңҚеҠЎеҷЁиө„жәҗе°‘пјҢжүҖд»ҘдҪҝз”ЁFilebeatдҪңдёәеә”з”ЁжңҚеҠЎеҷЁз«Ҝзҡ„ж—Ҙеҝ—收йӣҶеҷЁпјҢдёҖиҲ¬Filebeatдјҡй…ҚеҗҲLogstashдёҖиө·дҪҝз”ЁпјҢиҝҷз§ҚйғЁзҪІж–№ејҸд№ҹжҳҜзӣ®еүҚжңҖеёёз”Ёзҡ„жһ¶жһ„ гҖӮ

ж–Үз« жҸ’еӣҫ

3. еј•е…Ҙзј“еӯҳйҳҹеҲ—зҡ„йғЁзҪІжһ¶жһ„иҜҘжһ¶жһ„еңЁз¬¬дәҢз§Қжһ¶жһ„зҡ„еҹәзЎҖдёҠеј•е…ҘдәҶKafkaж¶ҲжҒҜйҳҹеҲ—пјҲиҝҳеҸҜд»ҘжҳҜе…¶д»–ж¶ҲжҒҜйҳҹеҲ—пјү пјҢ е°ҶFilebeat收йӣҶеҲ°зҡ„ж•°жҚ®еҸ‘йҖҒиҮіKafka пјҢ 然еҗҺеңЁйҖҡиҝҮLogstasthиҜ»еҸ–Kafkaдёӯзҡ„ж•°жҚ®пјҢиҝҷз§Қжһ¶жһ„дё»иҰҒжҳҜи§ЈеҶіеӨ§ж•°жҚ®йҮҸдёӢзҡ„ж—Ҙеҝ—收йӣҶж–№жЎҲпјҢдҪҝз”Ёзј“еӯҳйҳҹеҲ—дё»иҰҒжҳҜи§ЈеҶіж•°жҚ®е®үе…ЁдёҺеқҮиЎЎLogstashдёҺElasticsearchиҙҹиҪҪеҺӢеҠӣ гҖӮ

ж–Үз« жҸ’еӣҫ

4. д»ҘдёҠдёүз§Қжһ¶жһ„зҡ„жҖ»з»“第дёҖз§ҚйғЁзҪІжһ¶жһ„з”ұдәҺиө„жәҗеҚ з”Ёй—®йўҳпјҢзҺ°е·ІеҫҲе°‘дҪҝз”ЁпјҢзӣ®еүҚдҪҝз”ЁжңҖеӨҡзҡ„жҳҜ第дәҢз§ҚйғЁзҪІжһ¶жһ„ пјҢ иҮідәҺ第дёүз§ҚйғЁзҪІжһ¶жһ„дёӘдәәи§үеҫ—жІЎжңүеҝ…иҰҒеј•е…Ҙж¶ҲжҒҜйҳҹеҲ—пјҢйҷӨйқһжңүе…¶д»–йңҖжұӮпјҢеӣ дёәеңЁж•°жҚ®йҮҸиҫғеӨ§зҡ„жғ…еҶөдёӢпјҢFilebeat дҪҝз”ЁеҺӢеҠӣж•Ҹж„ҹеҚҸи®®еҗ‘ Logstash жҲ– Elasticsearch еҸ‘йҖҒж•°жҚ® гҖӮ

еҰӮжһң Logstash жӯЈеңЁз№Ғеҝҷең°еӨ„зҗҶж•°жҚ®пјҢе®ғдјҡе‘ҠзҹҘ Filebeat еҮҸж…ўиҜ»еҸ–йҖҹеәҰ гҖӮжӢҘеЎһи§ЈеҶіеҗҺ пјҢ Filebeat е°ҶжҒўеӨҚеҲқе§ӢйҖҹеәҰ并继з»ӯеҸ‘йҖҒж•°жҚ® гҖӮ

й—®йўҳеҸҠи§ЈеҶіж–№жЎҲ1. й—®йўҳпјҡеҰӮдҪ•е®һзҺ°ж—Ҙеҝ—зҡ„еӨҡиЎҢеҗҲ并еҠҹиғҪпјҹзі»з»ҹеә”з”Ёдёӯзҡ„ж—Ҙеҝ—дёҖиҲ¬йғҪжҳҜд»Ҙзү№е®ҡж јејҸиҝӣиЎҢжү“еҚ°зҡ„пјҢеұһдәҺеҗҢдёҖжқЎж—Ҙеҝ—зҡ„ж•°жҚ®еҸҜиғҪеҲҶеӨҡиЎҢиҝӣиЎҢжү“?гҖӮ?ж•Ідёӣи°‘иӨӮиӮҠLK收йӣҶж—Ҙеҝ—зҡ„ж—¶еҖҷе°ұйңҖиҰҒе°ҶеұһдәҺеҗҢдёҖжқЎж—Ҙеҝ—зҡ„еӨҡиЎҢж•°жҚ®иҝӣиЎҢеҗҲ并 гҖӮ

и§ЈеҶіж–№жЎҲпјҡдҪҝз”ЁFilebeatжҲ–Logstashдёӯзҡ„multilineеӨҡиЎҢеҗҲ并жҸ’件жқҘе®һзҺ°

еңЁдҪҝз”ЁmultilineеӨҡиЎҢеҗҲ并жҸ’件зҡ„ж—¶еҖҷйңҖиҰҒжіЁж„Ҹ пјҢ дёҚеҗҢзҡ„ELKйғЁзҪІжһ¶жһ„еҸҜиғҪmultilineзҡ„дҪҝз”Ёж–№ејҸд№ҹдёҚеҗҢ пјҢ еҰӮжһңжҳҜжң¬ж–Үзҡ„第дёҖз§ҚйғЁзҪІжһ¶жһ„пјҢйӮЈд№ҲmultilineйңҖиҰҒеңЁLogstashдёӯй…ҚзҪ®дҪҝз”ЁпјҢеҰӮжһңжҳҜ第дәҢз§ҚйғЁзҪІжһ¶жһ„пјҢйӮЈд№ҲmultilineйңҖиҰҒеңЁFilebeatдёӯй…ҚзҪ®дҪҝз”ЁпјҢж— йңҖеҶҚеңЁLogstashдёӯй…ҚзҪ®multiline гҖӮ

1пјүmultilineеңЁFilebeatдёӯзҡ„й…ҚзҪ®ж–№ејҸпјҡ

filebeat.prospectors:-paths:- /home/project/elk/logs/test.loginput_type: logmultiline:pattern: '^['negate: truematch: afteroutput:logstash:hosts: ["localhost:5044"]- patternпјҡжӯЈеҲҷиЎЁиҫҫејҸ

- negateпјҡй»ҳи®ӨдёәfalseпјҢиЎЁзӨәеҢ№й…Қpatternзҡ„иЎҢеҗҲ并еҲ°дёҠдёҖиЎҢпјӣtrueиЎЁзӨәдёҚеҢ№й…Қpatternзҡ„иЎҢеҗҲ并еҲ°дёҠдёҖиЎҢ

- matchпјҡafterиЎЁзӨәеҗҲ并еҲ°дёҠдёҖиЎҢзҡ„жң«е°ҫ пјҢ beforeиЎЁзӨәеҗҲ并еҲ°дёҠдёҖиЎҢзҡ„иЎҢйҰ–

pattern: '['negate: truematch: afterиҜҘй…ҚзҪ®иЎЁзӨәе°ҶдёҚеҢ№й…ҚpatternжЁЎејҸзҡ„иЎҢеҗҲ并еҲ°дёҠдёҖиЎҢзҡ„жң«е°ҫ2пјүmultilineеңЁLogstashдёӯзҡ„й…ҚзҪ®ж–№ејҸ

input {beats {port => 5044}}filter {multiline {pattern => "%{LOGLEVEL}s*]"negate => truewhat => "previous"}}output {elasticsearch {hosts => "localhost:9200"}}

жҺЁиҚҗйҳ…иҜ»

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

- ж–°жңәicloudжҒўеӨҚеҰӮдҪ•еҒңжӯў

- Pythonзҡ„rangeеҮҪж•°еҶ…йғЁжҳҜжҖҺд№Ҳе®һзҺ°зҡ„?

- ж·ұе…ҘLinuxеҶ…ж ёпјҡжҺўз§ҳиҝӣзЁӢе®һзҺ°зҡ„зҘһз§ҳдё–з•Ң

- еҰӮдҪ•з”ЁJavaе®һзҺ°еӣҫеғҸиҜҶеҲ«е’ҢеӣҫеғҸеӨ„зҗҶпјҹ

- Nodejs зҡ„ CommonJS 规иҢғе®һзҺ°еҺҹзҗҶ

- еҫ®дҝЎжҠ•зҘЁиғҪе’Ӣеҫ—ж“ҚдҪңпјҢ第дёүж–№еҫ®дҝЎжҠ•зҘЁзі»з»ҹжҠ•зҘЁйҖҒзӨјзү©жҖҺд№Ҳе®һзҺ°

- PyTorchеӣўйҳҹйҮҚеҶҷгҖҢеҲҶеүІдёҖеҲҮгҖҚжЁЎеһӢпјҢжҜ”еҺҹе§Ӣе®һзҺ°еҝ«е…«еҖҚ

- Spring Boot и°ғдјҳеҶ…еөҢ Tomcat зҡ„дёүз§Қж–№жі•

- еҘіз”ҹдҪ©жҲҙжҠӨиә«з¬Ұзҡ„зҰҒеҝҢ еҘіз”ҹдҪ©жҲҙжҠӨиә«з¬Ұзҡ„зҰҒеҝҢж„ҝжңӣе®һзҺ°еҗҺеҗҗиЎҖ

- Spring еҫ®жңҚеҠЎдёӯзҡ„еҲҶеёғејҸдјҡиҜқ