е·ҘдҪң|дәәе·ҘжҷәиғҪвҖңдёҠеІ—вҖқпјҢдҪ зҡ„йҘӯзў—иҝҳиғҪдҝқдҪҸеҗ—пјҹ( дәҢ )

е‘ҳе·ҘдёҺдәәе·ҘжҷәиғҪдёҚд»…д»…жҳҜеңЁеҠһе…¬е®ӨйҮҢиҝӣиЎҢдә’еҠЁ гҖӮ еҚҸдҪңжңәеҷЁдәәпјҲcobotпјүеңЁе·ҘеҺӮдёӯи¶ҠжқҘи¶Ҡжҷ®йҒҚ пјҢ е®ғ们被装еӨҮжҲҗдёҺе·ҘзЁӢеёҲ们дёҖиө·ж“ҚдҪң пјҢ жҠҠйҮҚзү©жҲ–иҖ…е·Ҙе…·ж”ҫеҲ°йҖӮеҪ“зҡ„ең°ж–№пјӣеңЁд»“еә“дёӯ пјҢ дҫӢеҰӮдәҡ马йҖҠзҡ„еӨ§еһӢи®ҫж–Ҫ пјҢ жңәеҷЁдәәеё®еҠ©дәәзұ»е·ҘдәәжҢ‘йҖүиҙ§зү©е№¶жү“еҘҪеҢ… пјҢ д»ҘдҫҝйҖҒиҙ§ гҖӮ

Julie ShahshжҳҜйә»зңҒзҗҶе·ҘеӯҰйҷўиҲӘз©әиҲӘеӨ©зі»еүҜж•ҷжҺҲ пјҢ д№ҹжҳҜи®Ўз®—жңә科еӯҰдёҺдәәе·ҘжҷәиғҪе®һйӘҢе®ӨпјҲCSAILпјүдәӨдә’ејҸжңәеҷЁдәәз»„зҡ„иҙҹиҙЈдәә пјҢ д»–и®Өдёә пјҢ ејҖеҸ‘еҮәиғҪеӨҹд»ҘиҮӘ然е’ҢеҸҜйқ зҡ„ж–№ејҸдёҺдәәзұ»дә’еҠЁзҡ„дәәе·ҘжҷәиғҪзі»з»ҹж„Ҹе‘ізқҖиғҪеӨҹйў„жөӢ并йҖӮеә”дәәзұ»е·ҘдҪңиҖ…зҡ„йңҖжұӮ пјҢ жҲ–иҖ…жҚўеҸҘиҜқиҜҙ пјҢ еӯҰд№ жҲҗдёәдёҖеҗҚдјҳз§Җзҡ„еӣўйҳҹеҗҲдҪңиҖ… гҖӮ

ShahиҜҙпјҡвҖңдәәе·ҘжҷәиғҪжңүзқҖе·ЁеӨ§зҡ„жҪңеҠӣ пјҢ жҲ‘们дёҚжҳҜи®©дәәе·ҘжҷәиғҪжқҘжүҝжӢ…йқһеёёе…·жңүжҢ‘жҲҳжҖ§зҡ„е·ҘдҪңпјҲеңЁиҝҷдәӣе·ҘдҪңдёӯ пјҢ жҳҜз”ұдәәзұ»жқҘи§ЈжһҗжЁЎзіҠе’ҢдёҚзЎ®е®ҡзҡ„дҝЎжҒҜпјү пјҢ иҖҢжҳҜи®©е®ғеҺ»зҗҶи§ЈжҲ‘们жҳҜжҖҺж ·еҒҡеҲ°зҡ„并жҸҗдҫӣж”ҜжҢҒ пјҢ и®©е®ғжҸҗдҫӣжӯЈзЎ®зҡ„дҝЎжҒҜ пјҢ жҸҗеҮәе»әи®® пјҢ д»Ҙдҫҝи®©дәәзұ»иғҪеӨҹжңүжӣҙеӨҡзҡ„зІҫеҠӣеҺ»д»ҺдәӢжӣҙе…·жҢ‘жҲҳжҖ§зҡ„е·ҘдҪң гҖӮ вҖқ

еҘ№зҡ„з ”з©¶йӣҶдёӯеңЁдәәе·ҘжҷәиғҪжңәеҷЁдәәжҖҺж ·жӣҙжңүж•Ҳең°дёҺдәәзұ»е·Ҙдәәдә’еҠЁвҖ”вҖ”ж— и®әжҳҜеҜ»жүҫж–№жі•зЎ®дҝқжұҪиҪҰз”ҹдә§зәҝдёҠзҡ„жңәеҷЁдәәеңЁжӯЈзЎ®ж—¶й—ҙжҸҗдҫӣжӯЈзЎ®зҡ„жқҗж–ҷ пјҢ иҝҳжҳҜејҖеҸ‘жҷәиғҪж”ҜжҢҒзі»з»ҹ пјҢ д»Ҙеё®еҠ©дәәзұ»е®ҢжҲҗеҫҲжңүжҢ‘жҲҳжҖ§зҡ„еҶізӯ–д»»еҠЎ гҖӮ

еҘ№иҜҙпјҡвҖңжҲ‘еңЁе®һйӘҢе®Өзҡ„жүҖжңүе·ҘдҪңйғҪйӣҶдёӯеңЁејҖеҸ‘иғҪеӨҹеғҸжӢјеӣҫдёҖж ·ж•ҙеҗҲеңЁдёҖиө·зҡ„дәәе·ҘжҷәиғҪ пјҢ зӣ®зҡ„жҳҜеўһејәдәәзұ»зҡ„иғҪеҠӣ пјҢ иҖҢдёҚжҳҜеҸ–д»Јдәәзұ»зҡ„е·ҘдҪң гҖӮ иҝҷиғҢеҗҺзҡ„е…ій”®жҠҖжңҜжҳҜиғҪеӨҹжҺЁж–ӯеҮәдёҖдёӘдәәеңЁжғід»Җд№Ҳпјҹ他们зҡ„зІҫзҘһзҠ¶жҖҒпјҹ并预жөӢ他们дёӢдёҖжӯҘдјҡеҒҡд»Җд№Ҳ пјҢ еңЁйҖӮеҪ“зҡ„ж—¶еҖҷеҸӮдёҺиҝӣжқҘ пјҢ 并жҸҗдҫӣжӯЈзЎ®зҡ„дҝЎжҒҜжҲ–иҖ…жӯЈзЎ®зҡ„зү©ж–ҷ гҖӮ вҖқ

иҝҷж„Ҹе‘ізқҖиҰҒжЁЎд»ҝдәәзұ»ж“…й•ҝжү§иЎҢзҡ„еӨҚжқӮиҝҮзЁӢ пјҢ дҫӢеҰӮ пјҢ ејҖеҸ‘иғҪеӨҹйў„жөӢе·ҘдәәиҝҗеҠЁзҡ„з®—жі• гҖӮ

ShahиҜҙпјҡвҖңжҲ‘зҡ„еӨ§йғЁеҲҶе·ҘдҪңйғҪйӣҶдёӯеңЁвҖҳжҖҺж ·еңЁжӯЈзЎ®зҡ„ж—¶й—ҙжҢүз…§жӯЈзЎ®зҡ„йЎәеәҸжҸҗдҫӣжӯЈзЎ®зҡ„дҝЎжҒҜпјҹеңЁиЈ…й…ҚзәҝдёҠжҖҺж ·еңЁжӯЈзЎ®зҡ„ж—¶й—ҙжҢүз…§жӯЈзЎ®зҡ„йЎәеәҸжҸҗдҫӣжӯЈзЎ®зҡ„йӣ¶д»¶пјҹвҖҷиҝҷдәӣжҳҜд»»еҠЎеҲҶй…Қи°ғеәҰй—®йўҳ пјҢ иҝҷе°ұжҳҜи®©жҲ‘们зҡ„дё–з•ҢиҝҗиҪ¬иө·жқҘзҡ„еҠЁеӣ гҖӮ вҖқ

йә»зңҒзҗҶе·ҘеӯҰйҷўCSAILеңЁиҙқж–Ҝд»ҘиүІеҲ—еҰҮ科еҢ»з–—дёӯеҝғпјҲBeth Israel Deaconess Medical CenterпјүиҝӣиЎҢзҡ„дёҖдёӘз ”з©¶йЎ№зӣ®и°ғжҹҘдәҶдәәзұ»еңЁе·ҘдҪңеңәжүҖдҝЎд»»дәәе·ҘжҷәиғҪзҡ„ж„Ҹж„ҝ гҖӮ иҜҘйЎ№зӣ®ж¶үеҸҠеҲ°дҪҝз”Ёжүҳз®ЎеңЁдёҖдёӘдәәеҪўNaoжңәеҷЁдәәдёҠзҡ„дәәе·ҘжҷәиғҪзі»з»ҹ пјҢ е…¶дёәеҢ»йҷўдә§жҲҝжҸҗдҫӣжҺ’зЁӢе»әи®® пјҢ еңЁиҝҷз§ҚзҺҜеўғдёӢ пјҢ йңҖиҰҒиҝһз»ӯдёҚж–ӯең°еҚіж—¶еҒҡеҮәеҶізӯ–жқҘеҚҸи°ғжҠӨзҗҶе·ҘдҪң гҖӮ

иҙҹиҙЈдәәжҳҜжҠӨеЈ«й•ҝ пјҢ еҘ№зҡ„д»»еҠЎжҳҜеҗҢж—¶еҚҸи°ғз”ұ10еҗҚжҠӨеЈ«е’Ң20еҗҚз—…дәәз»„жҲҗзҡ„еӣўйҳҹ пјҢ иҝҳиҰҒе®үжҺ’еҘҪ20дёӘжҲҝй—ҙ гҖӮ жҺ’зЁӢжңүеҫҲеӨҡеҸҜеҸҳеӣ зҙ пјҢ жҠӨеЈ«й•ҝиҰҒе°қиҜ•йў„жөӢдёҖдәӣеӣ зҙ пјҢ жҜ”еҰӮдә§еҰҮд»Җд№Ҳж—¶еҖҷеҲҶеЁ© пјҢ еҲҶеЁ©жҢҒз»ӯеӨҡд№… пјҢ зӯүзӯү гҖӮ

ShahиҜҙпјҡвҖңеҘ№д»¬еҹәжң¬дёҠжҳҜеңЁеҢ»йҷўеҗ„дёӘжҘјеұӮжү®жј”з©әдёӯдәӨйҖҡз®ЎеҲ¶е‘ҳзҡ„и§’иүІ пјҢ еҶіе®ҡе“Әдәӣз—…дәәеҺ»е“ӘдёӘжҲҝй—ҙ пјҢ е“ӘдәӣжҠӨеЈ«еҲҶй…Қз»ҷе“Әдәӣз—…дәә гҖӮ вҖқ

дәәе·ҘжҷәиғҪзі»з»ҹиў«и®ӯз»ғжҲҗеӨҚеҲ¶жҠӨеЈ«й•ҝжү§иЎҢзҡ„жҺ’зЁӢе·ҘдҪң пјҢ иғҪеӨҹйў„жөӢжҲҝй—ҙеҲҶй…Қ пјҢ е»әи®®жҠҠе“ӘдәӣжҠӨеЈ«еҲҶй…Қз»ҷе“ӘеҸ°жүӢжңҜ гҖӮ жҠӨеЈ«еҸҜд»ҘиҜўй—®жңәеҷЁдәә пјҢ жңәеҷЁдәәйҖҡиҝҮж–Үжң¬иҜӯйҹіиҪ¬жҚўиҪҜ件з»ҷеҮәе»әи®® гҖӮ

еңЁзҺ°еңәиҜ•зӮ№жј”зӨәдёӯ пјҢ жҠӨеЈ«90%зҡ„ж—¶й—ҙйғҪдјҡжҺҘеҸ—дәәе·ҘжҷәиғҪзҡ„е»әи®® пјҢ еҗҢж—¶д№ҹдјҡд»ҘеҗҢж ·зҡ„жҜ”дҫӢжӢ’з»қвҖңдҪҺиҙЁйҮҸвҖқзҡ„е»әи®® гҖӮ жқҘиҮӘжҠӨеЈ«зҡ„еҸҚйҰҲжҳҜз§ҜжһҒзҡ„ пјҢ еҸӮдёҺдәәе‘ҳејәи°ғдәҶеҹ№и®ӯж–°е‘ҳе·Ҙе’ҢеҲҶжӢ…е·ҘдҪңйҮҸзҡ„еҘҪеӨ„ гҖӮ

жҲ‘们дҝЎд»»дәәе·ҘжҷәиғҪеҗ—пјҹ

йҡҸзқҖи¶ҠжқҘи¶ҠеӨҡзҡ„е‘ҳе·ҘеңЁе·ҘдҪңдёӯдёҺдәәе·ҘжҷәиғҪдәӨдә’ пјҢ е‘ҳе·ҘеҸҠе…¶дјҒдёҡйғҪеҸҜиғҪдјҡжҸҗеҮәз–‘й—® пјҢ д»Җд№Ҳж—¶еҖҷйҖӮеҗҲдҫқиө–з®—жі•жқҘеҒҡеҮәйҮҚеӨ§еҶізӯ– пјҢ иҖҢд»Җд№Ҳж—¶еҖҷдәәзұ»зҡ„иғҢжҷҜзҹҘиҜҶжӣҙжңүд»·еҖј гҖӮ

жҜҸдёҖз§ҚйҖүжӢ©йғҪжңүе…¶зӣёеҜ№зҡ„дјҳеҠҝ пјҢ иҖҢдәәе·ҘжҷәиғҪзі»з»ҹеҸҜд»ҘйҒҝе…ҚдёҖдәӣдәәзұ»еҸҜиғҪжІЎжңүж„ҸиҜҶеҲ°зҡ„еҒҸи§Ғ гҖӮ AtheyиҜҙпјҡвҖңз®—жі•иғҪеӨҹж•ҙеҗҲйӮЈдәӣдәәзұ»ж”¶йӣҶиө·жқҘжҲҗжң¬иҝҮй«ҳзҡ„дҝЎжҒҜвҖқ пјҢ д»–еҲ—дёҫдәҶд»ҺжұӮиҒҢиҖ…дёӯзӯӣйҖүз®ҖеҺҶзҡ„дҫӢеӯҗ гҖӮ

AtheyиҜҙпјҡвҖңдёҖдёӘдәәеңЁзңӢз®ҖеҺҶж—¶ пјҢ еҸҜиғҪдјҡеӣ дёәе°‘ж•°дәәзҡ„еҺҹеӣ иҖҢеҜ№жҹҗжүҖеӨ§еӯҰж•ҙдҪ“дёҠжңүжҲҗи§Ғ пјҢ дҪҶдәәе·ҘжҷәиғҪиғҪеӨҹйҳ…иҜ»еҗҢж ·зҡ„дҝЎжҒҜ пјҢ жӣҙеҮҶзЎ®ең°иҜ„дј°иҝҷжүҖеӨ§еӯҰ究з«ҹжҖҺж · гҖӮ д№ҹи®ёз®—жі•зҹҘйҒ“иҝҷжҳҜдёҖжүҖиҫғејұзҡ„е·һз«ӢеӨ§еӯҰ пјҢ дҪҶе·ҘзЁӢйЎ№зӣ®е®һйҷ…дёҠжҳҜй«ҳеәҰйҖүжӢ©жҖ§зҡ„ пјҢ иҖҢдәәзұ»дёҚдјҡиҠұж—¶й—ҙеҺ»ж”¶йӣҶиҝҷдәӣдҝЎжҒҜ гҖӮ вҖқ

еҗҢж—¶ пјҢ дәәе·ҘжҷәиғҪз®—жі•д№ҹжҳҜе®№жҳ“еҮәй”ҷзҡ„ пјҢ зЁӢеәҸдёӯеҸҜиғҪзј–еҶҷдәҶдёҖдәӣж„ҸжғідёҚеҲ°зҡ„еҒҸе·® пјҢ еӣ жӯӨйҖҸжҳҺжҖ§еҜ№дәҺдҝқиҜҒдәәзұ»зҹҘйҒ“жҹҗдёӘз®—жі•жңүеӨҡеҸҜдҝЎйқһеёёйҮҚиҰҒ гҖӮ

AtheyиҜҙпјҡвҖңдҪ дёҚеёҢжңӣдёҖдёӘз®—жі•жҖ»жҳҜжҺЁзҝ»дәәзұ»зҡ„еҶіе®ҡ пјҢ иҖҢдәәзұ»жҳҜдёҚдјҡеҗҢж„Ҹзҡ„пјҡиҝҷжҳҜдёҺзҺҜеўғзӣёе…ізҡ„ гҖӮ дҪ йңҖиҰҒе»әз«ӢдёҖз§ҚиғҪдј иҫҫи¶іеӨҹдҝЎжҒҜзҡ„з®—жі• пјҢ и®©дәәзұ»иғҪеӨҹзҗҶ解他们жҳҜеә”иҜҘеҗ¬з®—жі•зҡ„ пјҢ иҝҳжҳҜеә”иҜҘеҗ¬иҮӘе·ұзҡ„ пјҢ д»ҘеҸҠ他们еә”жҖҺж ·ж•ҙеҗҲз®—жі•дёӯзҡ„дҝЎжҒҜ гҖӮ вҖқ

ShahжҢҮеҮә пјҢ и®©дёҖдёӘзі»з»ҹеҸҜдҝЎе№¶дёҚзӯүдәҺи®©е®ғеҖјеҫ—дҝЎиө– гҖӮ дҫӢеҰӮ пјҢ еңЁиҲӘз©әе·Ҙдёҡдёӯ пјҢ з”ұдәҺйЈһиЎҢе‘ҳдҝЎд»»дёҚе®Ңе–„зҡ„й©ҫ驶иҲұиҮӘеҠЁеҢ–зі»з»ҹ пјҢ еҜјиҮҙдәҶи®ёеӨҡдәӢж•… гҖӮ

еҘ№иҜҙпјҡвҖңжҲ‘们зҹҘйҒ“ пјҢ жҜ”иҫғе®№жҳ“еңЁдёҖдёӘзі»з»ҹдёӯе»әз«ӢдёҚйҖӮеҪ“зҡ„дҝЎд»» гҖӮ дҪ еҸҜд»ҘеҒҡдёҖдәӣе°ҸдәӢпјҡеҰӮжһңи®©е®ғжӣҙжӢҹдәәеҢ– пјҢ еҰӮжһңи®©е®ғи·ҹдҪ иҜҙиҜқ пјҢ иҖҢдёҚжҳҜжҠҠжҢҮд»Өдёӯзҡ„ж–Үжң¬иҜ»еҮәжқҘ пјҢ йӮЈд№Ҳ пјҢ дәә们е°ұеҫҲжңүеҸҜиғҪйҒөд»Һзі»з»ҹзҡ„е»ә议并дҝЎд»»е®ғ гҖӮ

дҪҝиҝҷдәӣзі»з»ҹеҸҜдҝЎ пјҢ её®еҠ©дёҖдёӘдәәйҖӮеҪ“ең°ж ЎеҮҶ他们еҜ№зі»з»ҹзҡ„дҝЎд»» пјҢ иҝҷ并дёҚжҳҜй—®йўҳпјӣйҮҚиҰҒзҡ„жҳҜзҹҘйҒ“иҝҷдәӣзі»з»ҹд»Җд№Ҳж—¶еҖҷжҳҜеңЁе…¶иғҪеҠӣиҢғеӣҙеҶ…дҪңеҮәеҶіе®ҡ пјҢ д»Җд№Ҳж—¶еҖҷи¶…еҮәдәҶиғҪеҠӣиҢғеӣҙ пјҢ иҝҷж · пјҢ дәә们дҫҝиғҪеӨҹиҝӣдёҖжӯҘеўһејәжңәеҷЁзҡ„иғҪеҠӣ гҖӮ вҖқ

еҘ№иЎҘе……йҒ“пјҡвҖңжҲ‘们з»Ҹеёёй—® пјҢ вҖҳдәә们дҝЎд»»зі»з»ҹзҡ„ж„Ҹж„ҝжңүеӨҡејәпјҹвҖҷиҝҷдёӘй—®йўҳй—®й”ҷдәҶ гҖӮ жӯЈзЎ®зҡ„й—®йўҳжҳҜпјҡвҖҳиҝҷдёӘзі»з»ҹеҖјеҫ—дҝЎиө–еҗ—пјҹвҖҷжңүеҸҜдҝЎзҡ„зі»з»ҹ пјҢ иҝҳжңүеҖјеҫ—дҝЎиө–зҡ„зі»з»ҹ гҖӮ вҖқ

жҺЁиҚҗйҳ…иҜ»

- д»Ҡж—Ҙи¶Јй—»|зҲұиұҶжҺҘиҝһеҮәдәӢпјҢиҝҷж¬ЎиҪ®еҲ°зҺӢеҳүе°”дәҶпјҢеӨңдјҡзҫҺеҘіе®һеҲҷе·ҘдҪңзӣёе…і

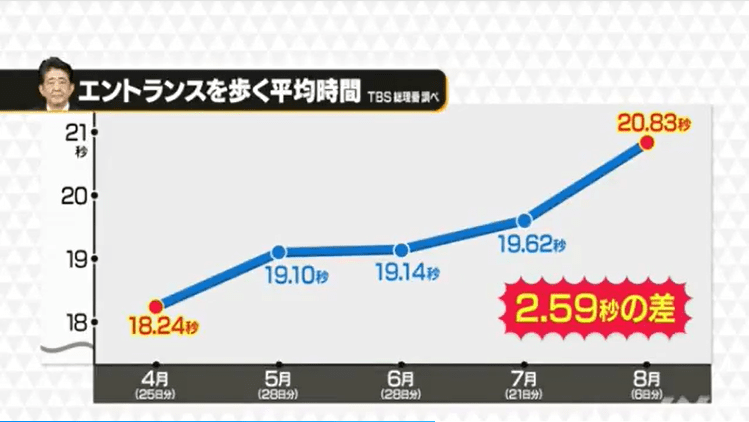

- жӢңзҷ»|жӢңзҷ»зқҖжүӢиҝҮжёЎе·ҘдҪң зЎ®и®ӨеҪ“йҖүзҫҺеӣҪжҖ»з»ҹиҝҳйңҖе“ӘдәӣжөҒзЁӢпјҹ

- дәәе·ҘжҷәиғҪ|еҢ—дә¬е°Ҷе»әзҷҫжүҖдәәе·ҘжҷәиғҪж•ҷиӮІе®һйӘҢж Ў

- зҫҺеӣҪеӣҪйҳІйғЁ|L3е“ҲйҮҢж–Ҝе…¬еҸёе°ҶдёәзҫҺеӣҪеӣҪйҳІйғЁејҖеҸ‘дәәе·ҘжҷәиғҪзі»з»ҹ

- зҺҜзҗғйӮ®жҠҘ|дёӯеӣҪй©»еҠ дҪҝйҰҶеҸ‘иЁҖдәәй©іж–ҘеҠ еӘ’жұЎи”‘жҠ№й»‘дёӯж–№иҝҪйҖғиҝҪиөғе·ҘдҪңиЁҖи®ә

- е»әи®ҫ|еҗҚеёҲе·ҘдҪңе®Өе»әи®ҫиҰҒеқҡжҢҒдёүдёӘвҖңдёҚвҖқ

- йқ’е№ҙе…¬еҜ“|з¬ҰеҗҲиҝҷдәӣжқЎд»¶зҡ„еӨ§еӯҰз”ҹпјҢеңЁиҙөйҳіе·ҘдҪңеҸҜз”іиҜ·йқ’е№ҙе…¬еҜ“е’ҢдҪҸжҲҝиЎҘиҙҙ

- зү№жң—жҷ®|жӢңзҷ»зқҖжүӢиҝҮжёЎе·ҘдҪң зү№жң—жҷ®з«һйҖүеӣўйҳҹжҸҗеҮәж–°зҡ„жі•еҫӢжҢ‘жҲҳ

- 笑声еҝ«иҪҰ|еј йӣЁз»®е·ҘдҪңз»“жқҹеҗҺдјҡеҸӢиҒҡйӨҗ, еҝғжғ…и¶…еҘҪзҺ°еңәиҲһи№Ҳж°”еңәеҚҒи¶і

- еј йӣЁз»®|еј йӣЁз»®е·ҘдҪңз»“жқҹеҗҺдјҡеҸӢиҒҡйӨҗпјҢеҝғжғ…и¶…еҘҪзҺ°еңәи·іиҲһж°”еңәеҚҒи¶і