еҸҰдёҖдёӘе…ідәҺеӨҡжҷәиғҪдҪ“е’ҢеӨ§еһӢиҜӯиЁҖжЁЎеһӢзҡ„жңүи¶Јй—®йўҳжҳҜпјҢеҰӮжһңAIзі»з»ҹеҸӘжҳҜзӣёдә’дәӨжөҒпјҢе®ғ们жҳҜдёҚжҳҜе°ұдёҚйңҖиҰҒдәәзұ»иҜӯиЁҖдәҶпјҹжҲ‘们жҳҜеҗҰиғҪдёәиҝҷдәӣAIзі»з»ҹи®ҫи®Ўжӣҙжңүж•Ҳзҡ„иҜӯиЁҖпјҹ

然иҖҢиҝҷеҸҲдјҡеј•еҸ‘дәҶеҸҰдёҖдәӣй—®йўҳпјҢжҲ‘们йңҖиҰҒз»ҷиҝҷдәӣд»ЈзҗҶгҖҒAIзЁӢеәҸзҡ„дәӨжөҒеҲ¶е®ҡ规еҲҷпјҢдәәзұ»иҜҘеҰӮдҪ•з®ЎзҗҶз”ұAIжһ„жҲҗзҡ„дәәе·ҘжҷәиғҪзӨҫдјҡпјҹ

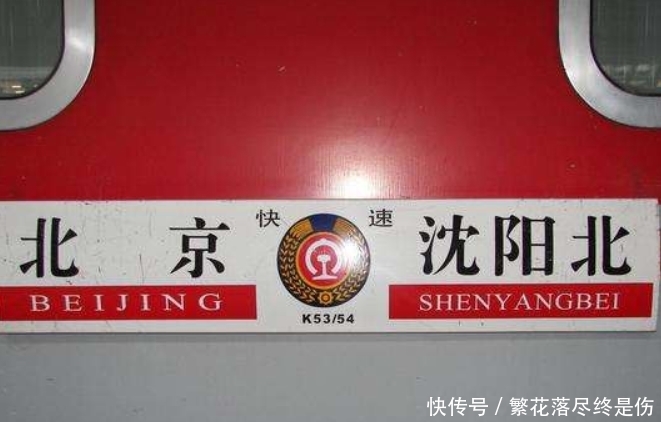

ж–Үз« жҸ’еӣҫ

Siriзҡ„й—®зӯ”

AIж— жі•д»Јжӣҝдәәзұ»еқҗзүў

иӢұеӣҪ科еӯҰ家иҝҲе…Ӣе°”·жі•жӢү第пјҲMichael FaradayпјүдәҺ1831е№ҙеҸ‘жҳҺдәҶз”өеҠЁжңәпјҢд»–д№ҹжІЎйў„ж–ҷеҲ°дјҡдә§з”ҹз”өжӨ…иҝҷз§ҚеҲ‘е…· гҖӮ1886е№ҙиҺ·еҫ—жұҪиҪҰдё“еҲ©зҡ„еҚЎе°”·жң¬иҢЁпјҲKarl BenzпјүиӮҜе®ҡж— жі•йў„иЁҖпјҢд»–зҡ„еҸ‘жҳҺеңЁжңӘжқҘзҡ„дёҖдёӘдё–зәӘйҮҢдјҡйҖ жҲҗж•°зҷҫдёҮдәәзҡ„жӯ»дәЎ гҖӮдәәе·ҘжҷәиғҪжҳҜдёҖй—ЁйҖҡз”ЁжҠҖжңҜпјҡе®ғзҡ„еә”з”Ёд»…д»…еҸ—йҷҗдәҺжҲ‘们зҡ„жғіиұЎ гҖӮ

еңЁдәәе·ҘжҷәиғҪи·Ёи¶ҠејҸеҸ‘еұ•зҡ„еҗҢж—¶пјҢжҲ‘们д№ҹйңҖиҰҒжіЁж„Ҹдәәе·ҘжҷәиғҪеҸҜиғҪеёҰжқҘзҡ„жҪңеңЁйЈҺйҷ©е’ҢжҢ‘жҲҳпјҢеҰӮж•°жҚ®йҡҗз§ҒгҖҒе°ұдёҡеІ—дҪҚжөҒеӨұзӯүй—®йўҳ гҖӮеӣ жӯӨпјҢеңЁжҺЁеҠЁдәәе·ҘжҷәиғҪжҠҖжңҜеҸ‘еұ•зҡ„еҗҢж—¶пјҢжҲ‘们д№ҹйңҖиҰҒи°Ёж…Һең°иҖғиҷ‘е…¶зӨҫдјҡе’ҢдјҰзҗҶеҪұе“ҚпјҢ并йҮҮеҸ–зӣёеә”зҡ„жҺӘж–Ҫ гҖӮ

еҰӮжһңжҲ‘们зңҹзҡ„иғҪжһ„е»әе…·жңүдәәзұ»жҷәеҠӣе’ҢиғҪеҠӣзҡ„AIпјҢйӮЈд№Ҳе®ғ们жҳҜеҗҰеә”иҜҘиў«и§ҶдёәдёҺдәәзұ»е№ізӯүзҡ„еӯҳеңЁпјҹе®ғ们жҳҜеҗҰеә”иҜҘжӢҘжңүиҮӘе·ұзҡ„жқғеҲ©е’ҢиҮӘз”ұпјҹиҝҷдәӣй—®йўҳйңҖиҰҒжҲ‘们и®ӨзңҹжҖқиҖғе’ҢжҺўи®Ё гҖӮ

иҷҺе—…пјҡдёӯж–Үдә’иҒ”зҪ‘жңүдёҖдёӘжңүи¶Јзҡ„и§ӮзӮ№пјҢ“AIж°ёиҝңдёҚеҸҜиғҪд»ҺдәӢдјҡи®ЎгҖҒе®Ўи®Ўе·ҘдҪң гҖӮеӣ дёәAIдёҚиғҪеқҗзүў гҖӮ”AIGCеңЁзүҲжқғж–№йқўеҗҢж ·еӯҳеңЁиҝҷж ·зҡ„й—®йўҳпјҢAIеҸҜд»ҘиҪ»жҳ“жҠ„иўӯдәәзұ»зҡ„з»ҳз”»гҖҒеҶҷдҪңйЈҺж јпјҢеҗҢж—¶дәәзұ»еҲ©з”ЁAIиҝӣиЎҢзҡ„еҲӣдҪңд№ҹеӯҳеңЁжқғеұһдёҚжҳҺзҡ„й—®йўҳ гҖӮйӮЈд№ҲжӮЁеҜ№дәәе·ҘжҷәиғҪеңЁжі•еҫӢгҖҒйҒ“еҫ·ж–№йқўйқўдёҙзҡ„йЈҺйҷ©жҖҺд№ҲзңӢпјҹ

иҝҲе…Ӣе°”·дјҚе°”еҫ·йҮҢеҘҮпјҡ“AIдёҚиғҪеқҗзүў”иҝҷдёӘжғіжі•йқһеёёеҰҷ гҖӮжңүдәӣдәәи®ӨдёәAIиғҪжҲҗдёә他们зҡ„“йҒ“еҫ·д»ЈзҗҶдәә”пјҢеҜ№е…¶иЎҢдёәиҙҹиҙЈ гҖӮ然иҖҢиҝҷз§Қжғіжі•жҳҺжҳҫжӣІи§ЈдәҶдәәзұ»еҜ№дәҺ“еҜ№гҖҒй”ҷ”зҡ„з•Ңе®ҡ гҖӮжҲ‘们дёҚиҜҘеҺ»иҖғиҷ‘жҖҺд№ҲеҲ¶йҖ “жңүйҒ“еҫ·иҙЈд»»”зҡ„AIпјҢиҖҢжҳҜеә”иҜҘд»ҘиҙҹиҙЈд»»зҡ„ж–№ејҸз ”з©¶AI гҖӮ

AIжң¬иә«ж— жі•иҙҹиҙЈпјҢдёҖж—ҰAIеҮәдәҶй—®йўҳпјҢжӢҘжңүAIгҖҒжһ„е»әAIе’ҢйғЁзҪІAIзҡ„дәәе°ұиҰҒиҙҹиҙЈ гҖӮеҰӮжһң他们дҪҝз”Ёзҡ„AIи§ҰзҠҜдәҶжі•еҫӢпјҢжҲ–иҖ…他们е°ҶAIз”ЁдәҺзҠҜзҪӘпјҢйӮЈд№Ҳеә”иҜҘиў«йҖҒиҝӣзӣ‘зӢұзҡ„дёҖе®ҡжҳҜдәәзұ» гҖӮ

жӯӨеӨ–пјҢChatGPTеңЁйҡҗз§ҒдҝқжҠӨж–№йқўйңҖиҰҒеҠ ејәзӣ‘з®Ў гҖӮеҰӮжһңChatGPT收йӣҶдәҶж•ҙдёӘдә’иҒ”зҪ‘зҡ„дҝЎжҒҜпјҢйӮЈд№Ҳд»–дёҖе®ҡд№ҹиҜ»еҲ°дәҶе…ідәҺжҲ‘们жҜҸдёӘдәәзҡ„дҝЎжҒҜ гҖӮдҫӢеҰӮпјҢжҲ‘зҡ„зӨҫдәӨеӘ’дҪ“гҖҒжҲ‘зҡ„д№ҰзұҚгҖҒжҲ‘зҡ„и®әж–ҮпјҢд»ҘеҸҠе…¶д»–дәәеңЁзӨҫдәӨеӘ’дҪ“дёҠеҜ№жҲ‘еҸ‘иЎЁзҡ„иҜ„и®әзӯүпјҢз”ҡиҮіжҳҜе·Із»ҸеҲ йҷӨдәҶзҡ„дҝЎжҒҜ гҖӮAIеҸҜиғҪиҝҳиғҪж №жҚ®иҝҷдәӣдҝЎжҒҜжҸҸз»ҳжҜҸдёӘдәәзҡ„з”»еғҸпјҢд»ҺиҖҢиҝӣдёҖжӯҘдҫөзҠҜжҲ–дјӨе®іжҲ‘们зҡ„йҡҗз§Ғ гҖӮ

зӣ®еүҚжңүеҫҲеӨҡе…ідәҺдәәе·ҘжҷәиғҪжі•еҫӢж–№йқўзҡ„и®Ёи®әпјҢ并дёҚеҸӘй’ҲеҜ№ChatGPTпјҢдәәе·ҘжҷәиғҪзҡ„жі•еҫӢй—®йўҳдёҖзӣҙеӯҳеңЁпјҢдё”ж—Ҙи¶ӢйҮҚиҰҒпјҢдҪҶзӣ®еүҚзӨҫдјҡеҗ„з•ҢеҜ№жӯӨиҝҳд»ҚеңЁи®Ёи®әе’Ңж‘ёзҙўйҳ¶ж®ө гҖӮ

жҲ‘и®ӨдёәChatGPTжҲ–жҳҜе…¶д»–зҡ„AIжҠҖжңҜеңЁжңӘжқҘеҮ е№ҙдёӯе°ҶдјҡеҸҳеҫ—и¶ҠжқҘи¶Ҡжҷ®йҒҚ гҖӮдҪҶжҳҜпјҢжҲ‘д№ҹи®ӨдёәжҲ‘们йңҖиҰҒи°Ёж…Һең°дҪҝз”Ёе®ғпјҢзЎ®дҝқжҲ‘们дёҚдјҡеӨұеҺ»дәәзұ»зҡ„е…ій”®жҠҖиғҪпјҢдҫӢеҰӮйҳ…иҜ»е’ҢеҶҷдҪң гҖӮAIж— з–‘еҸҜд»Ҙеё®еҠ©дәәзұ»жҸҗй«ҳз”ҹдә§ж•ҲзҺҮгҖҒз”ҹжҙ»иҙЁйҮҸпјҢдҪҶе®ғдёҚиғҪе®Ңе…ЁеҸ–д»Јдәәзұ»зҡ„жҖқз»ҙе’ҢеҲӣйҖ еҠӣ гҖӮ

гҖҗж·ұеәҰеӯҰд№ дёҚжҳҜAIзҡ„з»ҲжһҒзӯ”жЎҲгҖ‘

жҺЁиҚҗйҳ…иҜ»

- жӢӣиҒҳ|иғҢжҷҜи°ғжҹҘжҳҜдёҚжҳҜеҸӘжңүеӨ§е…¬еҸёжүҚйңҖиҰҒеҒҡпјҹ

- зҺ©жёёжҲҸдёҖзӣҙжҺүзәҝжҳҜдёҚжҳҜжҳҫеҚЎй—®йўҳ зҺ©жёёжҲҸдёҖзӣҙжҺүзәҝ

- жҪҳй•ҝжұҹ|вҖңеЈ®вҖқдёҚжҳҜй—®йўҳпјҢжқҺе…°иҝӘзҡ„вҖңдёҚжё…йҶ’вҖқпјҢж’•ејҖдәҶеӨҡе°‘еҘіжј”е‘ҳзҡ„йҒ®зҫһеёғ

- дҪ•зӮ…жҗһиҝҮжқҺж№ҳеҗ— зҺӢеІідјҰжқҺж№ҳ

- еӮ»еӯҗи°ҲжҒӢзҲұ жҒӢзҲұдёӯзҡ„дәәдёҚжҳҜиҜ—дәәе°ұжҳҜеӮ»еӯҗ

- дёәд»Җд№ҲеҸ«жұҹй—Ёз«ҷдёҚжҳҜеҸ«ж–°дјҡз«ҷ жұҹй—ЁиҪ»иҪЁз«ҷ

- дәәзҡ„100жқЎдјҳзӮ№е’ҢзјәзӮ№ дјҳзӮ№е’ҢзјәзӮ№

- дә”笔жү“еӯ—и®ӯз»ғиҪҜ件 дә”笔жү“еӯ—еӯҰд№

- з»ғеӯ—зҡ„з®Җжҳ“ж–№жі• з»ғеӯ—зҡ„ж–№жі•

- ж— зјқжҺҘиҪЁзҡ„жҒӢзҲұзҠ¶жҖҒжҳҜеҜ№зҡ„еҗ— жҒӢзҲұж— зјқиЎ”жҺҘжҳҜдёҚжҳҜе°ұз®—еҠҲи…ҝ е·ҘдҪңдёӯзҡ„ж— зјқиЎ”жҺҘд»Җд№Ҳж„ҸжҖқ