ж•°жҚ®ж”ҝжІ»дёЁж•°еӯ—еҢ–жІ»зҗҶпјҡдәәе·ҘжҷәиғҪзҡ„з«Ӣжі•еӣ°еўғ

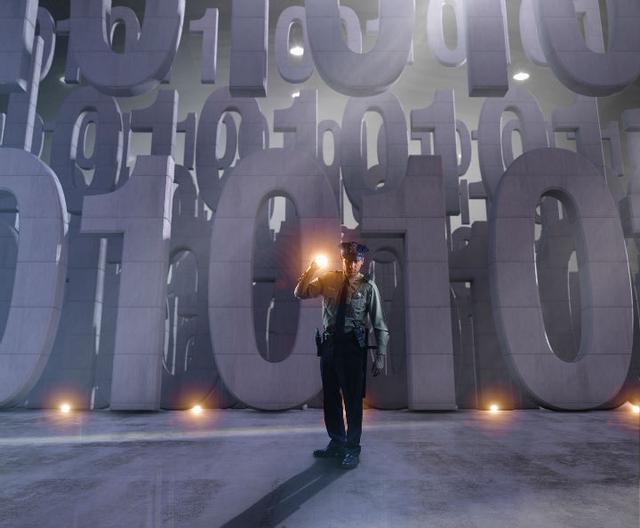

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

дәәе·ҘжҷәиғҪ时代已然жқҘдёҙ пјҢ иҜёеҰӮдәәи„ёиҜҶеҲ«гҖҒж— дәәй©ҫ驶гҖҒжҷәиғҪжңәеҷЁдәәи¶ҠжқҘи¶ҠеҸ—еҲ°дәә们зҡ„йқ’зқҗ гҖӮ дәә们дёҖж–№йқўдә«еҸ—зқҖдәәе·ҘжҷәиғҪжүҖеёҰжқҘзҡ„дҫҝеҲ© пјҢ дёҖж–№йқўеҜ№дәәе·ҘжҷәиғҪжҠҖжңҜзҡ„ж»Ҙз”Ёдә§з”ҹдәҶжӢ…еҝ§ пјҢ жҜ”еҰӮдёӘдәәдҝЎжҒҜйҡҗз§ҒдҝқжҠӨзӯүзӯү гҖӮ 11жңҲ19ж—ҘжҳҜгҖҠдёӘдәәдҝЎжҒҜдҝқжҠӨжі•пјҲиҚүжЎҲпјүгҖӢе…¬ејҖеҫҒжұӮж„Ҹи§ҒжҲӘжӯўж—Ҙжңҹ пјҢ иҖҢиҝҷд№ҹжҳҜеӣҪеҶ…йҰ–йғЁдё“门规е®ҡдёӘдәәдҝЎжҒҜдҝқжҠӨзҡ„жі•еҫӢ гҖӮ

е…¶е®һ пјҢ й’ҲеҜ№ж•°еӯ—з»ҸжөҺзҡ„з«Ӣжі•и¶ӢеҠҝеңЁе…ЁзҗғйғҪејҖе§ӢжҳҫзҺ° гҖӮ 10жңҲжң« пјҢ 欧жҙІи®®дјҡйҖҡиҝҮдәҶжңү关欧зӣҹеҰӮдҪ•жӣҙеҘҪең°зӣ‘з®Ўдәәе·ҘжҷәиғҪзҡ„дёүд»Ҫз«Ӣжі•еҖЎи®®жҠҘе‘Ҡ пјҢ д»ҘдҝғиҝӣеҲӣж–°гҖҒйҒ“еҫ·ж ҮеҮҶе’ҢжҠҖжңҜдҝЎд»» гҖӮ 欧зӣҹ委е‘ҳдјҡйў„и®ЎеҲ°2021е№ҙеҲқдјҡеҪўжҲҗе…ідәҺAIз«Ӣжі•зҡ„жҸҗжЎҲ гҖӮ

еҰӮдҪ•зңӢеҫ…дәәе·ҘжҷәиғҪзҡ„з«Ӣжі•й—®йўҳ пјҢ жңӘжқҘзҡ„ж–№еҗ‘еҸҲжҳҜд»Җд№ҲпјҹеҲҳеҝ—жҜ…и®Өдёә пјҢ жі•еҫӢ规еҲҷеҝ…йЎ»йҖӮеә”еҲӣж–°еҗҰеҲҷе°ұдјҡж— ж•ҲжҲ–иҖ…дә§з”ҹдёҚиүҜеҗҺжһң пјҢ еҸҰдёҖж–№йқўжі•еҫӢзі»з»ҹеҝ…йЎ»жңүдёҖе®ҡзҡ„йў„и§ҒжҖ§ пјҢ еҗҰеҲҷеҪ“ж·ұеәҰеӯҰд№ иҝҷж ·зҡ„з®—жі•е№ҝжіӣдҪҝз”Ёж—¶ пјҢ е°Ҷдјҡдә§з”ҹйў„жңҹеӨ–з”ҡиҮідёҚеҸҜйҖҶзҡ„з»“жһң гҖӮ

вҖ”вҖ”зј–иҖ…

еҲҳеҝ—жҜ…/ж–Үд»Ҙж·ұеәҰеӯҰд№ дёәд»ЈиЎЁзҡ„дәәе·ҘжҷәиғҪжҠҖжңҜеңЁиҝҷдёҖиҪ®дҝЎжҒҜжҠҖжңҜжөӘжҪ®дёӯйҖҗжёҗеҚ жҚ®дәҶдё»еҜјең°дҪҚеҗҺ пјҢ дёҖж–№йқўеёҰжқҘдәҶдёҚеҗҢдә§дёҡзҡ„жҷәиғҪеҢ–иҪ¬еһӢзҡ„еә”з”ЁеңәжҷҜиҗҪең° пјҢ дёҖж–№йқўд№ҹеёҰжқҘдәҶиҜёеӨҡжҢ‘жҲҳдёҺйЈҺйҷ© пјҢ е…¶дёӯдёҖзӮ№е°ұжҳҜеңЁжі•еҫӢеҲ¶и®ўдёҺеә”з”ЁеұӮйқўзҡ„йЈҺйҷ© гҖӮ йүҙдәҺдәәе·ҘжҷәиғҪжҠҖжңҜеә”з”Ёдёӯзҡ„жҷ®йҒҚжҖ§ пјҢ еҰӮжһңеҸӘжҳҜеҚ•з»ҙеәҰзҡ„иҖғиҷ‘е…¶еҪұе“ҚпјҲжҜ”еҰӮе°ұдәәе·ҘжҷәиғҪжҠҖжңҜз®—жі•еҜ№жі•еҫӢзҡ„еҪұе“Қпјү пјҢ е°ҶжңүеӨұеҒҸйўҮ пјҢ еӣ жӯӨжҲ‘们йҮҮеҸ–дёҖз§ҚжӣҙеҠ е®Ҹи§Ӯзҡ„и§Ҷи§’еҺ»зҗҶи§ЈиҝҷдёӘй—®йўҳ гҖӮ жҲ‘们дёҚд»…и®Ёи®әдҪҝз”Ёдәәе·ҘжҷәиғҪжҠҖжңҜеҰӮдҪ•дә§з”ҹдҪңз”Ёзҡ„еңәжҷҜ пјҢ еҗҢж—¶д№ҹдјҡи®Ёи®әдәәе·ҘжҷәиғҪжҠҖжңҜдҪңдёәеӨҚжқӮзҡ„зі»з»ҹеҢ–жҠҖжңҜеҜ№дҪҝз”ЁиҖ…е’Ң第дёүж–№зҡ„еҪұе“Қе’ҢйЈҺйҷ© пјҢ еҜ№дәәе·ҘжҷәиғҪжі•еҫӢе’ҢйҒ“еҫ·д№Ӣй—ҙзҡ„е…ізі»иҝӣиЎҢеҲқжӯҘзҡ„и®Ёи®әд»ҘеҸҠжҸҗдҫӣзҗҶи§Јзҡ„еҹәжң¬жЎҶжһ¶ гҖӮ

жі•еҫӢзҡ„жЎҶжһ¶

йҰ–е…ҲжҲ‘们йңҖиҰҒжҳҺзЎ®дёҖдёӘй—®йўҳ пјҢ дәәе·ҘжҷәиғҪжҠҖжңҜжүҖеёҰжқҘзҡ„еҪұе“ҚеҸҜиғҪж¶үеҸҠзӨҫдјҡгҖҒз»ҸжөҺд»ҘеҸҠдјҰзҗҶйўҶеҹҹ пјҢ иҖҢжҲ‘们жҳҜеҗҰйңҖиҰҒеҲ¶е®ҡдёҖдёӘжі•еҫӢжЎҶжһ¶жқҘдҝғиҝӣдёӘдәәдёҺе…¬е…ұзҡ„еҲ©зӣҠеңЁдәәе·ҘжҷәиғҪжҠҖжңҜзҡ„еҸ‘еұ•дёӯиғҪеӨҹиў«жӯЈзЎ®еј•еҜје‘ўпјҹиҷҪ然жҲ‘们еҸҜд»ҘзңӢеҲ°йқһж•°еӯ—еҢ–зҡ„жі•еҫӢ法规пјҲж°‘жі•гҖҒеҲ‘жі•гҖҒе…¬жі•жҲ–иҖ…其他规иҢғе’Ңж ҮеҮҶпјү пјҢ дҪҶжҳҜж•°еӯ—еҢ–дё–з•ҢйҮҢзҡ„жҢ‘жҲҳжҳҜеӨҚжқӮе’ҢеӨҡе…ғзҡ„ пјҢ еҚ•зәҜзҡ„еј•з”Ёйқһж•°еӯ—еҢ–дё–з•Ңзҡ„жі•еҫӢеҸҜиғҪ并дёҚиғҪж»Ўи¶ізӣёеә”еңәжҷҜзҡ„йңҖжұӮ гҖӮ

еҸҰдёҖж–№йқў пјҢ еҰӮжһңж–°зҡ„дәәе·ҘжҷәиғҪзӣёе…ізҡ„жі•еҫӢеҮәжқҘ пјҢ еҰӮдҪ•еә”иҜҘе°Ҷе®ғж”ҫеңЁжі•еҫӢдҪ“зі»зҡ„ж•ҙдҪ“жЎҶжһ¶еҶ…пјҹжҲ‘们зҹҘйҒ“еҚ•дёӘйўҶеҹҹзҡ„жі•еҫӢ规иҢғзі»з»ҹжҳҜдјҡдёҺж•ҙдёӘжі•еҫӢзі»з»ҹзӣёиҒ”зі»зҡ„ пјҢ дјҡйҖҡиҝҮдёҖе®ҡзҡ„规еҲ¶е’Ңж–№ејҸеөҢе…ҘеӨҚжқӮзҡ„жі•еҫӢжһ¶жһ„д№Ӣдёӯ пјҢ иҖҢдёҚеҗҢзҡ„жі•еҫӢжҳҜйңҖиҰҒдёҚеҗҢзҡ„иө„жәҗеҺ»ж”Ҝж’‘зҡ„ пјҢ д№ҹйңҖиҰҒеңЁдёҚеҗҢзҡ„зӨҫдјҡз»„з»ҮдёӯиҝӣиЎҢеӨҚжқӮзҡ„еҚҸдҪң пјҢ иҝҷжҳҜжҲ‘们зҗҶи§Јдәәе·ҘжҷәиғҪжҠҖжңҜз«Ӣжі•зҡ„第дёҖдёӘи§Ҷи§’ гҖӮ

е…¶ж¬Ў пјҢ жҲ‘们еҸҜд»ҘзңӢеҲ°жі•еҫӢе®һйҷ…дёҠжҳҜжІ»зҗҶжЁЎејҸзҡ„дёҖйғЁеҲҶ пјҢ еҜ№дәҺдәәе·ҘжҷәиғҪзҡ„з«Ӣжі•й—®йўҳжқҘиҜҙ пјҢ еҰӮдҪ•зңӢеҫ…е®ғзҡ„жІ»зҗҶжЁЎејҸ гҖӮ е®ғзҡ„жІ»зҗҶжЁЎејҸеҢ…жӢ¬еёӮеңәгҖҒз«һдәүгҖҒзҪ‘з»ңгҖҒеҗҲеҗҢе’Ңж•°еӯ—еҢ–жҺ§еҲ¶зӯүеӨҡдёӘж–№йқў пјҢ иҝҷдәӣж–№йқўзҡ„з»“жһ„е’ҢиҢғејҸе…¶е®һе°ұжҳҜеҗ„дёӘеӣҪ家жҺЁеҠЁдәәе·ҘжҷәиғҪж”ҝзӯ–е’Ңжі•еҫӢзҡ„еҹәжң¬е…ғзҙ пјҢ д№ҹжҳҜжҲ‘д»¬з ”з©¶ж•°еӯ—еҢ–жІ»зҗҶзҡ„еҹәжң¬йҖ»иҫ‘ гҖӮ

и‘—еҗҚеӯҰиҖ…еҚўиҘҝдәҡиҜә.еј—жҙӣйҮҢиҝӘжӣҫз»ҸеңЁд»–зҡ„дё“и‘—дёӯжҸҗеҲ° пјҢ вҖңж•°еӯ—еҢ–жІ»зҗҶжҳҜе»әз«Ӣе’Ңе®һи·өйҖӮеҪ“ејҖж”ҫгҖҒдҪҝз”Ёе’Ңз®ЎзҗҶдҝЎжҒҜеңҲзҡ„ж”ҝзӯ–гҖҒзЁӢеәҸе’Ңж ҮеҮҶзҡ„е®һи·ө пјҢ иҝҷд№ҹжҳҜдёҖдёӘжғҜдҫӢе’ҢиүҜеҘҪеҚҸдҪңзҡ„й—®йўҳ пјҢ жңүж—¶ж—ўи°ҲдёҚдёҠйҒ“еҫ·дёҺеҗҰ пјҢ дәҰи°ҲдёҚдёҠеҗҲжі•дёҺеҗҰ гҖӮ вҖқеӣ жӯӨ пјҢ йҖҡеёёж•°еӯ—еҢ–жІ»зҗҶзҡ„еҹәжң¬еҮәеҸ‘зӮ№е°ұжҳҜвҖңе–„жІ»вҖқ пјҢ еҚійҖҡиҝҮз®—жі•иҝӣиЎҢжІ»зҗҶжқҘдҝқиҜҒз¬ҰеҗҲйҒ“еҫ·иҰҒжұӮд»ҘеҸҠеҗҲ规жҖ§ пјҢ иҖҢдҫқжҚ®иҝҷж–№йқўзҡ„з ”з©¶ пјҢ е°ұеҫ—еҲ°дәҶе…ідәҺAIдјҰзҗҶзҡ„дёҖзі»еҲ—еҺҹеҲҷ гҖӮ йҮҮзәіиҝҷж ·зҡ„ж–№ејҸзҡ„еҺҹеӣ жҳҜеӣ дёәжі•еҫӢе’ҢйҒ“еҫ·д№Ӣй—ҙж·ұеҲ»зҡ„зӣёдә’дҪңз”Ё пјҢ еҚіжі•еҫӢе…·еӨҮйҒ“еҫ·еҹәзЎҖ пјҢ иҖҢйҒ“еҫ·дёҺеҺҹеҲҷеҸҲйҖҡиҝҮжі•еҫӢжқҘиҮӘжҲ‘еЎ‘йҖ пјҢ дҝқжҢҒдәҶдёҖе®ҡзҡ„еј№жҖ§з©әй—ҙ гҖӮ

зҺ°е®һзҡ„йҡңзўҚ

дәӢе®һдёҠ пјҢ 善治并дёҚжҳҜеҚ•зӢ¬дә§з”ҹзҡ„ пјҢ е®ғеҢ…жӢ¬жі•еҫӢгҖҒдјҰзҗҶгҖҒйҒ“еҫ·зӯүдёҖзі»еҲ—зҡ„еҶ…е®№ пјҢ еӣ жӯӨжҲ‘们йңҖиҰҒжҸҗдҫӣдёҖзі»еҲ—жІ»зҗҶзҡ„жЎҶжһ¶жқҘжҢҮеҜје…¶е®һж–ҪйҖ»иҫ‘ пјҢ д№ҹе°ұжҳҜиҜҙйҖҡеёёйқһж•°еӯ—еҢ–йўҶеҹҹйҖҡиҝҮжі•еҫӢдёәдё»дҪ“зҡ„жІ»зҗҶж–№ејҸ пјҢ еҲ°дәҶж•°еӯ—еҢ–з©әй—ҙеҲҷйңҖиҰҒеӨҡз®ЎйҪҗдёӢзҡ„еҺ»жІ»зҗҶ пјҢ иҝҷе…¶дёӯеҢ…жӢ¬д»ҘдёӢеҶ…е®№пјҡ

жҺЁиҚҗйҳ…иҜ»

- иҘҝйғЁж•°жҚ®еңЁCES 2021жҺЁеҮәеӨҡж¬ҫ4TBе®№йҮҸзҡ„ж——иҲ°зә§SSD

- WhatsApp收йӣҶз”ЁжҲ·ж•°жҚ®ж–°ж”ҝжғ№дј—жҖ’пјҢвҖңеҲ йҷӨWhatsAppвҖқеңЁеңҹиҖіе…¶дёҠзғӯжҗң

- жңӘжқҘжғіиҝӣе…ҘAIйўҶеҹҹпјҢиҜҘеӯҰд№ PythonиҝҳжҳҜJavaеӨ§ж•°жҚ®ејҖеҸ‘

- й»‘е®ўзӘғеҸ–250дёҮдёӘдәәж•°жҚ® ж„ҸеӨ§еҲ©иҝҗиҗҘе•ҶжҸҗйҶ’з”ЁжҲ·е°Ҫеҝ«жӣҙжҚўSIMеҚЎ

- йҳізӢ®жҠҘе‘Ҡпјҡ4жҲҗеҸ—и®ҝиҖ…и®ӨдёәиҮӘе·ұзҡ„ж•°жҚ®жҜ”е…Қиҙ№жңҚеҠЎжӣҙжңүд»·еҖј

- дёӯж¶ҲеҚҸзӮ№еҗҚеӨ§ж•°жҚ®зҪ‘з»ңжқҖзҶҹ еҸҚеҜ№еҲ©з”Ёж¶Ҳиҙ№иҖ…дёӘдәәж•°жҚ®з”»еғҸ

- еӯҰд№ еӨ§ж•°жҚ®жҳҜеҗҰйңҖиҰҒеӯҰд№ JavaEE

- ж„ҸеӨ§еҲ©иҝҗиҗҘе•ҶHo Mobileиў«жӣқж•°жҚ®жі„йңІ

- еҫ®иҪҜе®ҳж–№ж•°жҚ®жҒўеӨҚе·Ҙе…·еҚіе°Ҷжӣҙж–°пјҡжӣҙжҳ“дәҺдёҠжүӢ дјҳеҢ–жҒўеӨҚжҖ§иғҪ

- еҗ‘ж—Ҙи‘өйўҶиҲӘВ·еқҗеёӯи§ЈеҶіж–№жЎҲпјҡиҝңзЁӢеҚҸеҠ©жҺЁиҝӣж•°еӯ—еҢ–еҢ»з–—

![[иҫ…еҠ©и®ӯз»ғ]еҲҶжё…дё»ж¬ЎпјҢиҫ…еҠ©и®ӯз»ғеҸӘиғҪжҳҜиҫ…еҠ©пјҒ](http://ttbs.guangsuss.com/image/a9e56a600a9c6f896d0b8d5345ff816b)

![[иө°з§Ғ]иӯҰж–№зӘҒиўӯиө°з§Ғд»“еә“пјҢеҸ‘зҺ°10жһ¶е…ұиҪҙж—ӢзҝјзӣҙеҚҮжңәпјҢеұ…然жҳҜзәҜжүӢе·Ҙжү“йҖ](http://img88.010lm.com/img.php?https://image.uc.cn/s/wemedia/s/2020/c8ccb32baca45ed2b7fdedb939dbab14.jpg)