и°·жӯҢйҒ“жӯүпјҒеҪ»жҹҘAIдјҰзҗҶ专家被解йӣҮдёҖдәӢ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

жҷәдёңиҘҝпјҲе…¬дј—еҸ·пјҡzhidxcomпјү

дҪңиҖ… | жһ—еҚ“зҺ®

зј–иҫ‘ | Panken

жҷәдёңиҘҝ12жңҲ13ж—Ҙж¶ҲжҒҜ пјҢ ж·ұйҷ·вҖңи§ЈйӣҮй—ЁвҖқзҡ„и°·жӯҢCEOзҡ®жҹҘдјҠпјҲSundar PichaiпјүдәҺжң¬е‘ЁдёүжӯЈејҸеҸ‘ж–ҮйҒ“жӯү пјҢ иЎЁзӨәеңЁи°·жӯҢAIдјҰзҗҶеӣўйҳҹиҙҹиҙЈдәәTimnit GebruдёҖдәӢдёҠзҡ„еӨ„зҗҶж–№ејҸвҖңеңЁе…¬еҸёеҶ…йғЁж’ӯдёӢдәҶиҙЁз–‘зҡ„з§Қеӯҗ пјҢ еј•иө·дәҶйғЁеҲҶе‘ҳе·ҘеҜ№е…¬еҸёдҝЎеҝөзҡ„еҠЁж‘ҮвҖқ пјҢ 并жүҝиҜәе°Ҷз«Ӣ马е°ұTimnit Gebruиў«и§ЈйӣҮдёҖдәӢеҸ‘иө·и°ғжҹҘ гҖӮ

жӯӨеүҚ пјҢ Timnit GebruеӣўйҳҹжүҖи‘—зҡ„дёҖзҜҮAIдјҰзҗҶзӣёе…ізҡ„и®әж–ҮеңЁе®ЎзЁҝиҝҮзЁӢдёӯйҒӯи°·жӯҢж’ӨзЁҝ пјҢ GebruиҰҒжұӮи°·жӯҢй«ҳеұӮеҮәйқўи§ЈйҮҠж— жһңеҗҺ пјҢ еҸ‘йҖҒеӨҡе°ҒеҶ…йғЁйӮ®д»¶ пјҢ ж–Үеӯ—зӣҙжҢҮе…¬еҸёеҶ…йғЁеӯҳеңЁжҖ§еҲ«гҖҒж—ҸиЈ”еӨҡж ·жҖ§й—®йўҳ гҖӮ и°·жӯҢиҺ·жӮүеҗҺ пјҢ д»ҘвҖңGebruиЎҢдёәдёҚз¬ҰеҗҲй«ҳз®Ўж ҮеҮҶвҖқдёәз”ұиҫһйҖҖдәҶеҘ№ гҖӮ

е°ұеңЁзҡ®жҹҘдјҠеҸ‘ж–ҮйҒ“жӯүзҡ„еүҚдёҖеӨ© пјҢ еңЁи°·жӯҢйқўеҗ‘ж·ұиӮӨиүІе‘ҳе·ҘеҸ¬ејҖзҡ„дјҡи®®дёҠ пјҢ дәӢ件зӣёе…іж–№AIиҙҹиҙЈдәәJeff Deanе’ҢеүҜжҖ»иЈҒMegan KacholiaиҝҳиҝӣиЎҢдәҶз®ҖзҹӯеҸ‘иЁҖ пјҢ жңҹй—ҙдёҚж–ӯеҗҲзҗҶеҢ–и°·жӯҢзҡ„и§ЈйӣҮеҶіе®ҡ пјҢ дё”дёҚжҺҘеҸ—е‘ҳе·ҘзӣҙжҺҘжҸҗй—® гҖӮ зҹҘжғ…дәәеЈ«йҖҸйңІ пјҢ дёҖдәӣдәәиЎЁзӨәжғіиҰҒиҫһиҒҢ гҖӮ

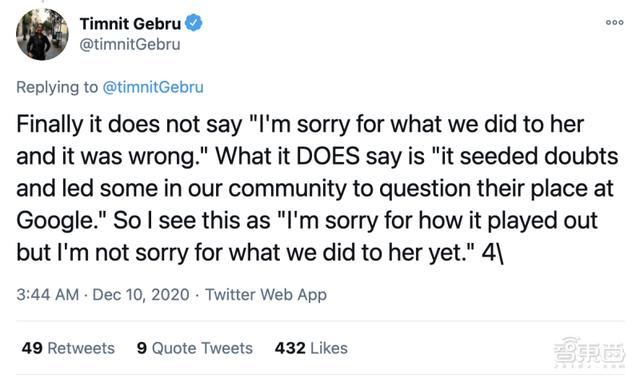

й’ҲеҜ№зҡ®жҹҘдјҠзҡ„йҒ“жӯү пјҢ иў«и§ЈйӣҮе‘ҳе·ҘGebruиЎЁзӨәдёҚдјҡжҺҘеҸ— пјҢ 并еңЁжҺЁзү№дёҠеҶҷйҒ“пјҡвҖңд»–еҸЈдёӯзҡ„гҖҢеңЁе…¬еҸёеҶ…йғЁж’ӯдёӢдәҶиҙЁз–‘зҡ„з§Қеӯҗ пјҢ еҜјиҮҙйғЁеҲҶе‘ҳе·ҘејҖе§ӢиҙЁз–‘иҮӘе·ұеңЁе…¬еҸёзҡ„ең°дҪҚгҖҚж„ҸжҖқж— ејӮдәҺгҖҢеҫҲжҠұжӯүдәӢжғ…еҸҳжҲҗиҝҷж · пјҢ дҪҶжҲ‘们并дёҚдёәеҸ‘з”ҹеңЁGebruиә«дёҠзҡ„дәӢж„ҹеҲ°жҠұжӯүгҖҚ гҖӮ вҖқ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

Timnit GebruеңЁжҺЁзү№жӢ’з»қи°·жӯҢCEO Sundar Pichaiзҡ„йҒ“жӯү

дёҖгҖҒTimnit GebruжҳҜи°ҒпјҹдёҖдҪҚй«ҳеӯҰеҺҶзҡ„е№іжқғжҙ»и·ғеҲҶеӯҗжӯӨж¬ЎдәӢ件зҡ„дё»дәәе…¬Timnit GebruжҳҜдёҖеҗҚи‘—еҗҚзҡ„AIдјҰзҗҶз ”з©¶е‘ҳ пјҢ еҚҡеЈ«жҜ•дёҡдәҺж–ҜеқҰзҰҸеӨ§еӯҰ пјҢ еёҲд»Һдәәе·ҘжҷәиғҪйўҶеҹҹзҹҘеҗҚеӯҰиҖ…жқҺйЈһйЈһ гҖӮ

еҺ»е№ҙ пјҢ GebruеҠ е…Ҙи°·жӯҢ пјҢ жӢ…д»»AIдјҰзҗҶеӣўйҳҹиҒ”еҗҲиҙҹиҙЈдәәдёҖиҒҢ пјҢ еңЁиҒҢжңҹй—ҙ пјҢ GebruдёҖзӣҙеҜ№и°·жӯҢеӯҳеңЁзҡ„з§Қж—ҸгҖҒжҖ§еҲ«еӨҡж ·жҖ§й—®йўҳзӣҙиЁҖдёҚи®і гҖӮ

Gebruеёёе№ҙжҙ»и·ғдәҺ科жҠҖйўҶеҹҹзҡ„й»‘дәәе’ҢеҘіжҖ§е№іжқғиҝҗеҠЁ пјҢ жҳҜй»‘дәәе№іжқғеҖЎи®®еӣўдҪ“Black in AIзҡ„еҲӣе§Ӣдәәд№ӢдёҖ гҖӮ

2018е№ҙ пјҢ GebruжӣҫеҸ‘иЎЁдәҶдёҖйЎ№еҪұе“Қж·ұиҝңзҡ„з ”з©¶жҲҗжһң пјҢ иҜҘз ”з©¶жҳҫзӨәIBMе’Ңеҫ®иҪҜзҡ„йқўйғЁиҜҶеҲ«иҪҜ件еңЁиҜҶеҲ«й»‘дәәеҘіжҖ§ж—¶иҜҜе·®зҺҮй«ҳиҫҫ35% пјҢ иҖҢиҜҶеҲ«зҷҪдәәз”·жҖ§ж—¶иҜҜе·®зҺҮеҮ д№Һдёәйӣ¶ гҖӮ

иҖҢиҝҷж¬Ўи§ЈйӣҮйЈҺжіўзҡ„вҖңе…ғеҮ¶вҖқз«ҹ然д№ҹжҳҜдёҖзҜҮи®әж–Ү гҖӮ

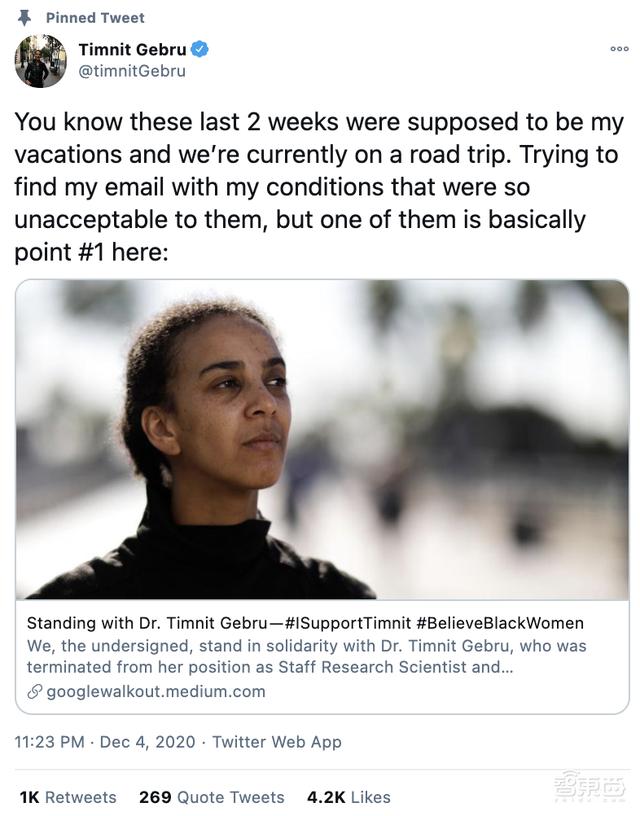

дәҢгҖҒйғҪжҳҜи®әж–Үжғ№зҡ„зҘёзҫҺеӣҪж—¶й—ҙ12жңҲ2ж—Ҙ пјҢ GebruеңЁжҺЁзү№еҸ‘ж–Үз§° пјҢ еңЁеҗ‘и°·жӯҢеҶ…йғЁеӣўдҪ“Brain Women and AlliesеҸ‘йҖҒдёҖе°ҒйӮ®д»¶д№ӢеҗҺ пјҢ е°ҡеңЁдј‘еҒҮзҡ„еҘ№йҒӯеҲ°дәҶи°·жӯҢзҡ„дёҚжӯЈеҪ“и§ЈйӣҮ пјҢ дјҒдёҡиҙҰжҲ·д№ҹиў«зҰҒз”Ё гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

Timnit Gebruз§°йҒӯи°·жӯҢи§ЈйӣҮж—¶жӯЈеңЁдј‘еҒҮ

и°·жӯҢе‘ҳе·ҘжҠ—и®®еӣўдҪ“Google Walkout For Real ChangeиҙЁз–‘иҜҘеҶіе®ҡзҡ„еҗҲзҗҶжҖ§е№¶еҸ‘иө·иҜ·ж„ҝ пјҢ и¶…дёӨеҚғеҗҚи°·жӯҢе‘ҳе·ҘгҖҒдёүеҚғеҗҚдёҡеҶ…专家зӯҫзҪІиҜ·ж„ҝд№Ұ гҖӮ

иҝҷеңәзә·дәүжңҖе…ҲејҖе§ӢдәҺдёҖзҜҮеҗҚдёәгҖҠйҡҸжңәй№Ұй№үд№Ӣйҷ©пјҡиҜӯиЁҖжЁЎеһӢдјҡеӨӘеӨ§еҗ—пјҹпјҲOn the Dangers of Stochastic Parrots: Can Language Models Be Too Big?пјүгҖӢзҡ„и®әж–Ү пјҢ иҝҷзҜҮи®әж–Үд»ҺзҺҜдҝқе’ҢжҲҗжң¬и§’еәҰгҖҒз§Қж—Ҹе’ҢжҖ§еҲ«ж–№йқўжҺўи®ЁдәҶеӨ§еһӢиҜӯиЁҖжЁЎеһӢеёҰжқҘзҡ„дёҖдәӣйЈҺйҷ© гҖӮ дҪңиҖ…жҢҮеҮә пјҢ зҺ°жңүж•°жҚ®д»…иғҪд»ЈиЎЁжңүиғҪеҠӣдёҠзҪ‘зҡ„зӨҫдјҡдјҳеҠҝзҫӨдҪ“ пјҢ еҰӮдёҚеҠ еҢәеҲҶең°дҪҝз”Ёиҝҷдәӣж•°жҚ®и®ӯз»ғдәәе·ҘжҷәиғҪ пјҢ дјҡиҝӣдёҖжӯҘеҠ еү§еҒҸи§Ғд»ҘеҸҠе°‘ж•°зҫӨдҪ“зҡ„иҫ№зјҳеҢ–зЁӢеәҰ гҖӮ

иҖҢеӨ§еһӢиҜӯиЁҖжЁЎеһӢжӯЈжҳҜи°·жӯҢдј—еӨҡе…ій”®жҠҖжңҜзҡ„еҹәзЎҖ гҖӮ 2018е№ҙ пјҢ и°·жӯҢжҺЁеҮәзҡ„BERTиҜӯиЁҖжЁЎеһӢеңЁдәәе·ҘжҷәиғҪйўҶеҹҹеј•иө·иҪ°еҠЁ пјҢ иҝҷйЎ№жҠҖжңҜзӣ®еүҚе·Іе№ҝжіӣиҝҗз”ЁеҲ°и°·жӯҢжҗңзҙўеј•ж“Һзҡ„и®ӯз»ғдёҠ гҖӮ

иҝҷзҜҮи®әж–Үз”ұж—¶д»»и°·жӯҢAIдјҰзҗҶз ”з©¶е‘ҳзҡ„Timnit GebruгҖҒеҚҺзӣӣйЎҝеӨ§еӯҰи®Ўз®—иҜӯиЁҖеӯҰз»Ҳиә«ж•ҷжҺҲEmily M. BenderзӯүдёғдәәдёҖеҗҢе®ҢжҲҗ пјҢ йҷӨGebruеӨ– пјҢ жңүеӣӣеҗҚдҪңиҖ…еқҮдёәи°·жӯҢе‘ҳе·Ҙ гҖӮ

жҢүз…§и®ЎеҲ’ пјҢ иҝҷзҜҮж–Үз« е°ҶжҠ•йҖ’иҮіжҳҺе№ҙдёҫиЎҢзҡ„FATеӯҰдјҡдёҠпјҲACM Conference on Fairness, Accountability, and Transparencyпјү гҖӮ 然иҖҢ пјҢ и°·жӯҢй«ҳеұӮд»ҘйҖ’дәӨдёҚз¬ҰеҗҲе®ЎзЁҝ规иҢғгҖҒж–Үз« еӯҳеңЁзјәйҷ·дёәзҗҶз”ұ пјҢ иҰҒжұӮдҪңиҖ…еӣўйҳҹж’Өеӣһи®әж–Ү пјҢ жҲ–иҖ…иҮіе°‘йҡҗеҺ»дҪңиҖ…зҡ„и°·жӯҢе‘ҳе·Ҙиә«д»Ҫ гҖӮ

жҺЁиҚҗйҳ…иҜ»

- и°·жӯҢжөҸи§ҲеҷЁжӢҹзҰҒ用第дёүж–№Cookies йҒӯиӢұеӣҪеҸҚеһ„ж–ӯи°ғжҹҘ

- и°·жӯҢе»әз«Ӣж–°AIзі»з»ҹ еҸҜејҖеҸ‘з”ңе“Ғй…Қж–№

- йёҝи’ҷиҺ·ж¬§дјҒеҠӣжҢәпјҒеҚҺдёәзҡ„еӨ§ж—¶д»Је°ҶеҲ°жқҘпјҢи°·жӯҢиә«дёҠйҮҚзҺ°иҜәеҹәдәҡзҡ„еҪұеӯҗ

- и°·жӯҢж–°ж¬ҫNest HubжҲ–иғҪиҝҪиёӘзқЎзң дҪҶеӨ–еӘ’жҸҗеҮәиҜёеӨҡз–‘й—®

- вҖңе…ЁиғҪзҘһвҖқејҖеҸ‘и°·жӯҢеә”з”ЁAPPдј ж’ӯйӮӘж•ҷж•ҷд№ү

- и°·жӯҢвҖңи·Ёе№ҙеӨңвҖқDoodleеёҰеӨ§е®¶дёҖиө·еҖ’и®Ўж—¶

- и°·жӯҢжҺЁеҮәж–°зүҲPixel 4a 5GпјҡйӘҒйҫҷ765GиҠҜ/еҚ–3200е…ғ

- FTC委е‘ҳз§°иӢ№жһңгҖҒи°·жӯҢжҳҜ移еҠЁжёёжҲҸиЎҢдёҡзҡ„вҖңзңӢй—ЁдәәвҖқ

- е‘ҳе·Ҙ|зҫҺеӣҪ科жҠҖеӨ§е…¬еҸёдёӯзҪ•и§ҒжҲҗз«Ӣе·ҘдјҡпјҢи°·жӯҢпјҡдјҡзӣҙжҺҘе’Ңе‘ҳе·Ҙи°Ҳ

- и°·жӯҢдҝ®еӨҚPixel 5зі»з»ҹйҹійҮҸй—®йўҳ еҝ«й—Ёйҹіж•ҲдёҚеҶҚеҗө