з»ҷдҪ и®ІжҳҺзҷҪпјҒиӢ№жһңеҲҡеҲҡеҸ‘еёғзҡ„жүӢжңәжҝҖе…үйӣ·иҫҫеҲ°еә•жңүд»Җд№Ҳз”Ёпјҹ

д»ҠеӨ©еҮҢжҷЁзҡ„иӢ№жһңеҸ‘еёғдјҡдёҠ пјҢ iPhone 12 жӯЈејҸйқўдё– гҖӮ дёҺеҹәжң¬жңәеһӢзӣёжҜ” пјҢ iPhone 12 Pro е’Ң iPhone 12 Pro Max зҡ„еҗҺзҪ®ж‘„еғҸеӨҙйҷӨдәҶеӨҡдёҖжһҡй•ҝз„Ұй•ңеӨҙ пјҢ иҝҳеўһеҠ дәҶдёҖйў— LiDAR пјҢ жҝҖе…үйӣ·иҫҫжү«жҸҸд»Ә гҖӮ

иҝҷйў—жҝҖе…үйӣ·иҫҫжҳҜд»Җд№Ҳпјҹе®ғиғҪдёәдҪ зҡ„жүӢжңәеёҰжқҘд»Җд№Ҳж–°дҪ“йӘҢпјҹ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

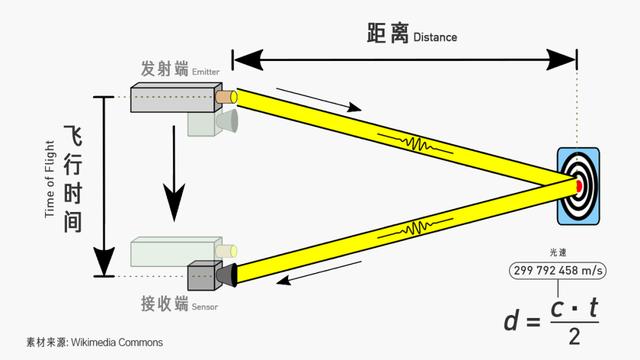

еңЁиҝҷеқ—еңҶеҪўй»‘иүІеҢәеҹҹд№ӢдёӢ пјҢ LiDAR дё»иҰҒз”ұдёӨйғЁеҲҶз»„жҲҗпјҡеҸ‘е°„з«Ҝе’ҢжҺҘ收з«Ҝ гҖӮ еһӮзӣҙи…”йқўеҸ‘е°„жҝҖе…үеҷЁпјҲVCSELпјүдҪңдёәеҸ‘е°„з«Ҝ пјҢ еҗ‘зү©дҪ“еҸ‘е°„дёҖжқҹзәўеӨ–е…ү пјҢ з»ҸеҸҚе°„иў« CMOS еӣҫеғҸдј ж„ҹеҷЁжҺҘ收 пјҢ е…үжқҹз»ҸеҺҶзҡ„иҝҷдёҖж®өж—¶й—ҙиў«з§°дёәйЈһиЎҢж—¶й—ҙпјҲToFпјү гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

йЈһиЎҢж—¶й—ҙеҸҲеҲҶдёәзӣҙжҺҘйЈһиЎҢж—¶й—ҙпјҲdToFпјүе’Ңй—ҙжҺҘйЈһиЎҢж—¶й—ҙпјҲiToFпјү гҖӮ еүҚиҖ…еҗ‘зӣ®ж ҮеҸ‘е°„дёҖдёӘе…үи„үеҶІдҝЎеҸ· пјҢ зӣҙжҺҘжөӢйҮҸе…үеӯҗд»ҺеҮәеҸ‘еҲ°иҝ”еӣһзҡ„з”Ёж—¶пјӣеҗҺиҖ…еҸ‘е°„дёҖиҝһдёІз»ҸиҝҮи°ғеҲ¶зҡ„е…үжіў пјҢ йҖҡиҝҮжЈҖжөӢжқҘеӣһе…үжіўй—ҙзҡ„зӣёдҪҚе·®жөӢйҮҸйЈһиЎҢж—¶й—ҙ гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

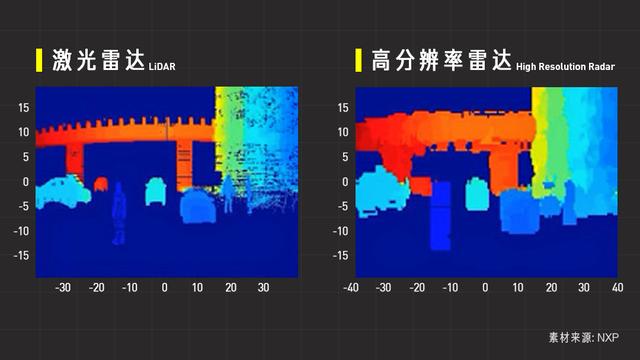

е·ІзҹҘе…үйҖҹ пјҢ йҖҡиҝҮз®ҖеҚ•зҡ„и®Ўз®—жҲ‘们е°ұиғҪеҫ—еҲ°дёҺзӣ®ж Үзү©дҪ“д№Ӣй—ҙзҡ„и·қзҰ» гҖӮ иҝҷж ·зҡ„жөӢи·қеҺҹзҗҶдёҺйӣ·иҫҫзұ»дјј пјҢ дёҚиҝҮ пјҢ LiDAR еҹәдәҺзҡ„жҳҜи„үеҶІжҝҖе…ү пјҢ жҜ”йӣ·иҫҫеҲ©з”Ёзҡ„ж— зәҝз”өжіўжіўй•ҝжӣҙзҹӯгҖҒйў‘зҺҮжӣҙй«ҳ пјҢ еҸҜд»Ҙеҫ—еҲ°еҲҶиҫЁзҺҮжӣҙй«ҳзҡ„еӣҫеғҸ пјҢ зІҫеәҰеҸҜиҫҫеҺҳзұіз”ҡиҮіжҜ«зұізә§еҲ« гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

еӣ жӯӨ пјҢ LiDAR д№ҹиў«еә”з”ЁеңЁең°еӣҫжөӢз»ҳгҖҒиҮӘеҠЁй©ҫ驶гҖҒж–Үзү©дҝқжҠӨзӯүйўҶеҹҹ гҖӮ иҖҢеҲ°дәҶжүӢжңә пјҢ е®ғеҸҲиғҪеҒҡдәӣд»Җд№Ҳе‘ўпјҹ

иҝҷдёҚжҳҜиӢ№жһң第дёҖж¬ЎеңЁе®ғзҡ„дә§е“ҒйҮҢеј•е…ҘжҝҖе…үйӣ·иҫҫ гҖӮ ж—©еңЁд»Ҡе№ҙ 3 жңҲ пјҢ 2020 ж¬ҫ iPad Pro е°ұй…ҚеӨҮдәҶ LiDAR жү«жҸҸеҠҹиғҪ пјҢ йҮҮз”ЁзӣҙжҺҘйЈһиЎҢж—¶й—ҙжҠҖжңҜпјҲdToFпјү пјҢ зӣёжҜ” iToF пјҢ еҠҹиҖ—иҫғдҪҺдё”дёҚжҳ“еҸ—зҺҜеўғе…үзҡ„е№Іжү° пјҢ еҸҜд»ҘеҒҡеҲ°еӨ§иҢғеӣҙжөӢйҮҸ гҖӮ

дҪҝз”Ёж—¶ пјҢ еҸ‘е°„еҷЁжҠ•е°„еҮә 9 * 64 еӨ§е°Ҹзҡ„зҹ©йҳөе…үжқҹ пјҢ жҚ•жҚү并з»ҳеҲ¶жңҖиҝң 5 зұіиҢғеӣҙеҶ…зҡ„дҪҚзҪ®ж·ұеәҰеӣҫ гҖӮ ж”№еҸҳ пјҢ йҰ–е…ҲеҸ‘з”ҹеңЁдҪ жӢҚж‘„зҡ„з…§зүҮйҮҢ гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

дёҖеј еҮәиүІзҡ„жө…жҷҜж·ұз…§зүҮ пјҢ жҳҜйҖҡиҝҮи°ғеӨ§зӣёжңәе…үеңҲ并еҜ№з„ҰеңЁи·қзҰ»зӣёжңәиҫғиҝ‘зҡ„ең°ж–№е®һзҺ°зҡ„ гҖӮ д»ҠеӨ© пјҢ йҖҡиҝҮеӨҡдёӘж‘„еғҸеӨҙе’ҢжңәеҷЁеӯҰд№ з®—жі•зҡ„её®еҠ© пјҢ з”ЁжүӢжңәд№ҹиғҪиҪ»иҖҢжҳ“дёҫжӢҚеҮәиҝҷз§ҚиғҢжҷҜиҷҡеҢ–зҡ„ж•Ҳжһң гҖӮ

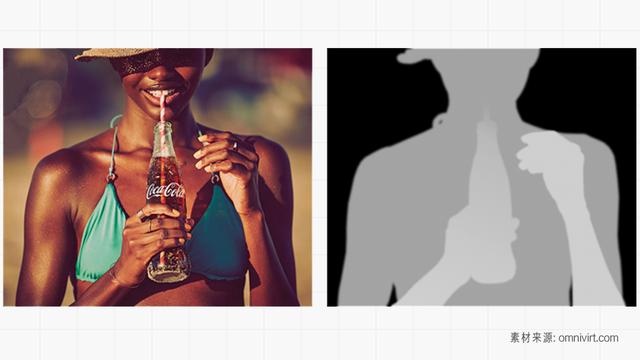

йҰ–е…Ҳ пјҢ зҘһз»ҸзҪ‘з»ңе’ҢжңәеҷЁеӯҰд№ жҠҖжңҜеҸҜд»Ҙи®©жүӢжңәзҹҘйҒ“жҲ‘们еңЁжӢҚд»Җд№Ҳ пјҢ д»ҘеҸҠзӣ®ж Үи·қзҰ»жҲ‘们жңүеӨҡиҝң гҖӮ еҜ№дәҺжҷ®йҖҡдәәжқҘиҜҙ пјҢ д»ҺдёҖеј з…§зүҮдёӯеҲӨж–ӯзү©дҪ“еұӮж¬Ўе’Ңиҝңиҝ‘е…ізі»жҳҜдёҖ件йқһеёёе®№жҳ“зҡ„дәӢ пјҢ дҪҶеҜ№дәҺжңәеҷЁ пјҢ еҲҷйңҖиҰҒеӨ§йҮҸзҡ„иө„жәҗжқҘеӯҰд№ пјҢ жҜ”еҰӮйўңиүІеҲҶеёғгҖҒжҳҺжҡ—зЁӢеәҰе’Ңзү©дҪ“е°әеҜё гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

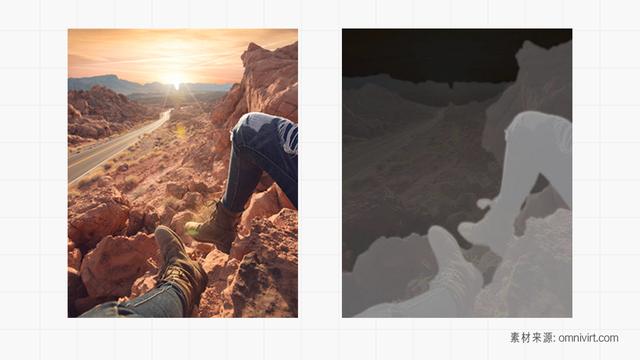

е°ұеғҸдёҠйқўиҝҷеј з…§зүҮ пјҢ жӣқе…үеәҰеқҮеҢҖдё”дё»йўҳжҳҺжҳҫ пјҢ жңәеҷЁеҫҲе®№жҳ“еҲҶжһҗеҮәи·қзҰ»й•ңеӨҙиҫғиҝ‘зҡ„зӮ№д»ҘеҸҠи·қзҰ»й•ңеӨҙиҫғиҝңзҡ„зӮ№ гҖӮ

еҸҜдёҖж—Ұз…§зүҮдёӯжңүжӣҙеӨҚжқӮзҡ„е…ізі» пјҢ дәӢжғ…е°ұеҸҳеҫ—жЈҳжүӢдәҶ гҖӮ

дәәзұ»жҲ–иҖ…еҠЁзү©зҡ„жҜӣеҸ‘гҖҒдё°еҜҢзҡ„иүІеҪ©гҖҒд»ҘеҸҠдёҺиғҢжҷҜйўңиүІжҺҘиҝ‘зҡ„иЎЈжңҚзӯү пјҢ йғҪеҫҲе®№жҳ“иў«жңәеҷЁиҜҜеҲӨдёәиғҢжҷҜ пјҢ е°Өе…¶жҳҜдё»дҪ“зҡ„иҫ№зјҳеҢәеҹҹ пјҢ е‘ҲзҺ°еҮәдёҚиҮӘ然зҡ„жЁЎзіҠж•Ҳжһң гҖӮ

LiDAR зҡ„еҠ е…ҘиғҪеёҰжқҘжӣҙзІҫеҮҶзҡ„ж·ұеәҰдҝЎжҒҜ пјҢ д»ҘдҫҝдәҺи®© iPhone зҗҶи§Јзү©дҪ“д№Ӣй—ҙзҡ„еүҚеҗҺе…ізі» пјҢ йҖҡиҝҮз®—жі•з»ҳеҲ¶еҮәдёҖеј з©әй—ҙдҪҚеӣҫ пјҢ 并е°Ҷз…§зүҮеҒҡеҲҮзүҮеӨ„зҗҶ гҖӮ iPhone дјҡеңЁеҮ зәіз§’еҶ…ж №жҚ®ж·ұеәҰдҝЎжҒҜеӣҫе°Ҷз…§зүҮеҲҮеҲҶжҲҗеӨҡд»Ҫ пјҢ и·қзҰ»и¶Ҡиҝңзҡ„еӣҫеұӮ пјҢ жЁЎзіҠзЁӢеәҰи¶Ҡй«ҳ пјҢ еҲ¶дҪңеҮәдёҖеј д»ҘеҒҮд№ұзңҹзҡ„жө…жҷҜж·ұдәәеғҸз…§зүҮ гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

еҗҢж—¶ пјҢ еңЁдҪҺе…үз…§жқЎд»¶дёӢ пјҢ iPhone зҡ„еҜ№з„ҰйҖҹеәҰд№ҹе°ҶеӨ§е№…жҸҗеҚҮ пјҢ 并且еҸҜд»ҘеңЁй»‘жҡ—дёӯеҮҶзЎ®жүҫеҲ°з”»йқўдёӯзҡ„дәәзү© пјҢ дёәеӨңй—ҙжЁЎејҸдёӢзҡ„дәәеғҸз…§зүҮжү“дёӢеҹәзЎҖ гҖӮ

жҺЁиҚҗйҳ…иҜ»

- з»ҷдҪ зҡ„iPhone12е…Ёж–№дҪҚдҝқжҠӨпјҡ6ж¬ҫжүӢжңәдҝқжҠӨеЈіжЁӘиҜ„

- дёҚйҖҒе……з”өеҷЁиҖіжңәпјҢиӢ№жһңдёҖе№ҙиғҪзңҒ17дәҝпјҹеә“е…Ӣзҡ„е°Ҹз®—зӣҳжү“еҫ—зңҹеҘҪ

- 马ж–Ҝе…ӢеҲҡжҲҗе…ЁзҗғйҰ–еҜҢпјҢиЎҢдёҡеҸҲзҲҶйҮҚзЈ…ж–°й—»пјҒзҷҫеәҰиҰҒйҖ жұҪиҪҰдәҶпјҢеҗҲдҪңж–№жҳҜе®ғпјҒдј дёҺиӢ№жһңеҗҲдҪңйҖ иҪҰпјҢйҹ©еӣҪжұҪиҪҰе·ЁеӨҙиӮЎд»·жҡҙж¶Ё

- SatechiжҺЁеҮәж–°ж¬ҫй“қеҲ¶иӢ№жһңй”®зӣҳдёҺiPadж”Ҝжһ¶й…Қ件

- з ”з©¶з§°iPhone 12еӣҪиЎҢ128GBзү©ж–ҷжҲҗжң¬жҸҗй«ҳдәҶ21%пјҡиӢ№жһңеҠ еҖҚиҪ¬е«Ғз»ҷж¶Ҳиҙ№иҖ…

- з”ЁжҲ·|е…ғж—ҰеҪ“еӨ©иӢ№жһңеә”з”Ёж¶Ҳиҙ№йўқи¶…иҝҮ5.4дәҝзҫҺе…ғ еҲ·ж–°еҚ•ж—Ҙж¶Ҳиҙ№и®°еҪ•

- иӢ№жһңеҲӣе§Ӣдәәд№”еёғж–Ҝзҡ„дј еҘҮдәәз”ҹпјҡйҖ е°ұдәҶиӢ№жһңзҡ„е·…еі°пјҢе…¶е®һжІЎйӮЈд№Ҳе®ҢзҫҺ

- дёҖеҲҷж¶ҲжҒҜдј жқҘпјҢиӢ№жһңiPhone12еҶҚзҺ°й—®йўҳпјҢвҖңжһңзІүвҖқжңүзӮ№ж…Ң

- иӢ№жһңдёӨж¬ҫж–°iPadйҪҗжӣқе…үпјҡжҖ§иғҪжҸҗй«ҳгҖҒе…Ҙй—Ёж¬ҫжӣҙиҪ»и–„гҖҒе”®д»·дҫҝе®ң

- Facebookеҗ‘е®ўжҲ·еҸ‘йӮ®д»¶пјҡеҜ№иӢ№жһңйҡҗз§Ғ新规вҖңеҲ«ж— йҖүжӢ©вҖқ