数字人正走进现实!AI大脑+高颜值,白皮书看懂四大关键技术五大应用 | 智东西内参( 二 )

21 世纪初 , 传统手绘逐渐被 CG、动作捕捉等技术取代 , 虚拟数字人步入探索阶段 。 该阶段的虚拟数字人开始达到实用水平 , 但造价不菲 , 主要出现在影视娱乐行业 , 如数字替身、虚拟偶像等 。 电影制作中的数字替身一般利用动作捕捉技术 , 真人演员穿着动作捕捉服装 , 脸上点上表情捕捉点 , 通过摄像机、动作捕捉设备将真人演员的动作、表情采集处理 , 经计算机处理后赋予给虚拟角色 。

2001 年 , 《指环王》中的角色咕噜就是由 CG 技术和动作捕捉技术产生 , 这些技术后续还在《加勒比海盗》、《猩球崛起》等电影制作中使用 。 2007 年 , 日本制作了第一个被广泛认可的虚拟数字人“初音未来” , 初音未来是二次元风格的少女偶像 , 早期的人物形象 主 要 利 用 CG 技 术合成,人物声音采用雅马哈的VOCALOID系列语音合成 , 呈现形式还相对粗糙 。

近五年 , 得益于深度学习算法的突破 , 数字人的制作过程得到有效简化 , 虚拟数字人开始步入正轨 , 进入初级阶段 。 该时期人工智能成为虚拟数字人不可分割的工具 , 智能驱动的数字人开始崭露头角 。

2018 年 , 新华社与搜狗联合发布的“AI合成主播” , 可在用户输入新闻文本后 , 在屏幕展现虚拟数字人形象并进行新闻播报 , 且唇形动作能与播报声音实时同步 。

2019 年 , 浦发银行和百度共同发布的数字员工“小浦” , 也是利用自然语言处理、语音识别、计算机视觉等人工智能技术制作的虚拟数字人 , 可通过移动设备为用户提供“面对面”的银行业务服务 。

当前 , 虚拟数字人正朝着智能化、便捷化、精细化、多样化发展 , 步入成长期 。 2019 年 , 美国影视特效公司数字王国软件研发部负责人 Doug Roble 在 TED 演讲时展示了自己的虚拟数字人“DigiDoug” , 可在照片写实级逼真程度的前提下 , 进行实时的表情动作捕捉及展现 。 今年 , 三星旗下的STAR Labs在CES国际消费电子展上展出了其虚拟数字人项目 NEON , NEON 是一种由人工智能所驱动的虚拟人物 , 拥有近似真人的形象及逼真的表情动作 , 具备表达情感和沟通交流的能力 。

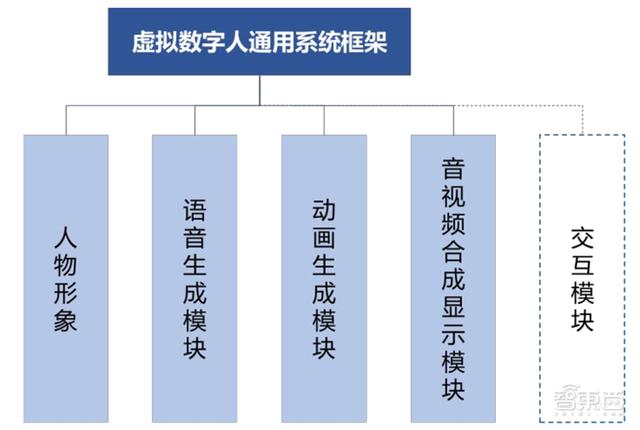

3、当前虚拟数字人通用系统框架及运作流程当前虚拟数字人作为新一代人机交互平台 , 仍处于发展期 , 还未有统一的通用系统框架 。 这份白皮书根据虚拟数字人的制作技术以及目前市场上提供的数字人服务和产品结构 , 总结出虚拟数字人通用系统框架 , 如下图所示 。 虚拟数字人系统一般情况下由人物形象、语音生成、动画生成、音视频合成显示、交互等 5 个模块构成 。

人物形象根据人物图形资源的维度 , 可分为 2D 和 3D 两大类 , 从外形上又可分为卡通、拟人、写实、超写实等风格; 语音生成模块和 动画生成模块可分别基于文本生成对应的人物语音以及与之相匹配的人物动画; 音视频合成显示模块将语音和动画合成视频 , 再显示给用户 。交互模块使数字人具备交互功能 , 即通过语音语义识别等智能技术识别用户的意图 , 并根据用户当前意图决定数字人后续的语音和动作 , 驱动人物开启下一轮交互 。

文章插图

文章插图

虚拟数字人通用系统框架

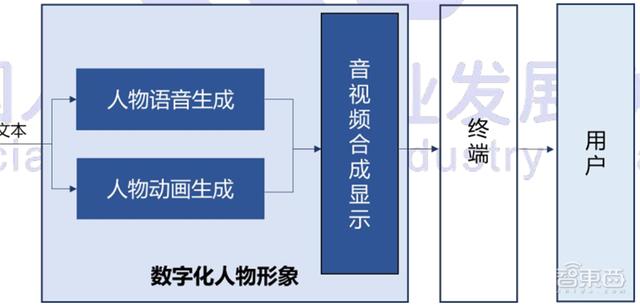

交互模块为扩展项 , 根据其有无 , 可将数字人分为交互型数字人和非交互型数字人 。 非交互型数字人体统的运作流程如下图非交互类虚拟数字人系统运作流程所示 。 系统依据目标文本生成对应的人物语音及动画 , 并合成音视频呈现给用户 。

文章插图

文章插图

非交互类虚拟数字人系统运作流程

交互型数字人根据驱动方式的不同可分为智能驱动型和真人驱动型 。智能驱动型数字人可通过智能系统自动读取并解析识别外界输入信息 , 根据解析结果决策数字人后续的输出文本 , 然后驱动人物模型生成相应的语音与动作来使数字人跟用户互动 。

推荐阅读

- 三星公司发布2021款数字座舱 集成诸多高科技

- 想实现《曼达洛人》的数字布景吗?索尼模块化屏幕即将开售

- 腾讯苏州战略合作再升级,腾讯(苏州)数字产业基地揭牌

- 索尼发布两款Crystal LED显示器 目标数字生产领域

- 向日葵领航·坐席解决方案:远程协助推进数字化医疗

- CES 2021「展望」:全数字化盛会 你最期待什么

- 腾讯云将携手8000家合作伙伴,助力长三角G60科创走廊数字化转型

- 腾讯与长三角G60科创走廊“牵手”:扩展科创“朋友圈”推进城市数字化转型

- 华为周建军:今年预计为顺德培养超过三千名数字化专业人才

- 闹剧再次上演!不想中国主导数字支付,美国这次盯上了蚂蚁和腾讯

![[励志视频短片]做好事,微笑挂满两腮才是正道!,早安心语:存好心](https://imgcdn.toutiaoyule.com/20200503/20200503054140414532a_t.jpeg)