иӢ№жһңеҸ‘еёғдјҡпјҡiPhone12еҠ йҮҸеҮҸд»·дәҶпјҢдҪҶжңҖеӨ§дә®зӮ№жҳҜдәәе·ҘжҷәиғҪ( дәҢ )

з»Ҹ典科幻з”өеҪұгҖҠ2001еӨӘз©әжј«жёёгҖӢ пјҢ д№ҹи®ёе°ұжҳҜеҜ№иҝҷдёӘй—®йўҳзҡ„жңҖеҘҪиҜ йҮҠ гҖӮ

еңЁиҝҷйғЁз”өеҪұдёӯ пјҢ жңүдёҖдёӘйҮҚиҰҒи§’иүІ пјҢ е°ұжҳҜеӨӘз©әйЈһиҲ№дёҠзҡ„дёҖеҘ—9000еһӢи®Ўз®—жңә пјҢ е®ғжңүдёҖдёӘзү№еҲ«зҡ„еҗҚеӯ—вҖңе“Ҳе°”вҖқ пјҢ иҝҷеҸ°жӢҘжңүдәәе·ҘжҷәиғҪзҡ„и®Ўз®—жңәзҡ„д»»еҠЎ пјҢ е°ұжҳҜеҚҸеҠ©дәәзұ»е®ҮиҲӘе‘ҳе®ҢжҲҗжҳҹйҷ…йЈһиЎҢе’ҢиҖғеҜҹд»»еҠЎ гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

еңЁеҪұзүҮдёӯ пјҢ йЈһиҲ№дёҠзҡ„9000еһӢи®Ўз®—жңәе“Ҳе°” пјҢ еңЁйЈһиҲ№зҡ„дҫӢиЎҢж•…йҡңжҠҘдҝ®е’ҢжЈҖжөӢдёӯ пјҢ з«ҹ然дә§з”ҹдәҶдёҖж¬Ўж— еҺҳеӨҙзҡ„иҜҜжҠҘ гҖӮ д№ҹе°ұжҳҜиҜҙ пјҢ е®ғе’Ңең°зҗғдёҠзҡ„еҗҢеһӢеҸ·и®Ўз®—жңә пјҢ ж №жҚ®дёҖжЁЎдёҖж ·зҡ„ж•°жҚ®гҖҒдёҖжЁЎдёҖж ·зҡ„зЁӢеәҸ пјҢ з«ҹ然еҫ—еҮәдәҶдёҚеҗҢзҡ„и®Ўз®—з»“жһң пјҢ иҝҷе°ұж„Ҹе‘ізқҖ пјҢ дёӨеҸ°и®Ўз®—жңәд№Ӣй—ҙеҪўжҲҗдәҶжҹҗз§ҚвҖңеҢәеҲҶвҖқ гҖӮ

然иҖҢ пјҢ иә«дёәдёҖеҸ°жңҖйЎ¶зә§зҡ„и®Ўз®—жңә пјҢ иҮӘиҙҹзҡ„е“Ҳе°”дёҚжүҝи®ӨиҮӘе·ұи®Ўз®—й”ҷиҜҜ пјҢ дәҺжҳҜе®ғжҠҠжүҖжңүзҡ„й”ҷиҜҜйғҪжҺЁеҲ°дәҶвҖңж„ҡи ўзҡ„дәәзұ»вҖқиә«дёҠ гҖӮ

еңЁе“Ҳе°”иЎЁзҺ°еҮәжӯ»дёҚи®Өй”ҷзҡ„еӨӘеӨҡеҗҺ пјҢ е®ҮиҲӘе‘ҳ们еҸ‘зҺ°дәҶе®ғзҡ„ејӮеёё пјҢ дәҺжҳҜ пјҢ 他们е•ҶйҮҸзқҖиҰҒйҮҚиЈ…е“Ҳе°”зҡ„зі»з»ҹ гҖӮ дҪҶиҝҷдёӘи®ЎеҲ’иў«е“Ҳе°”еҸ‘зҺ°дәҶ пјҢ дәҺжҳҜе®ғе…ҲдёӢжүӢдёәејә пјҢ е®Јз§°йЈһиҲ№дёҠзҡ„жҹҗдёӘйғЁд»¶еҚіе°ҶеӨұзҒө пјҢ д»ҘжӯӨдҪңдёәиҜұйҘө пјҢ и¶ҒжңәжқҖжӯ»дәҶиҲұеҶ…зҡ„еҮ дҪҚе®ҮиҲӘе‘ҳ гҖӮ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

е“Ҳе°”дҪңдёәдәәе·ҘжҷәиғҪ пјҢ дёәдҪ•дјҡдә§з”ҹжқҖдәәзҡ„йӮӘеҝөпјҹ

еҺҹи‘—дҪңиҖ…е…ӢжӢүе…ӢеңЁе°ҸиҜҙгҖҠеӨӘз©әжј«жёёгҖӢзҡ„第дәҢйғЁйҮҢеҗ‘жҲ‘们жҸӯзӨәеҮә пјҢ еҜјиҮҙиҝҷеңәжӮІеү§зҡ„ж №жң¬еҺҹеӣ е°ұжҳҜ пјҢ е“Ҳе°”дә§з”ҹдәҶиҮӘжҲ‘ж„ҸиҜҶ гҖӮ жҚўиЁҖд№Ӣ пјҢ е“Ҳе°”жңүдәҶвҖңиҮӘжҲ‘ж„ҸиҜҶвҖқ пјҢ е®ғзҡ„вҖңжҲ‘вҖқе°ұе’Ңдәәзұ»еҪўжҲҗдәҶвҖңдҪ жӯ»жҲ‘жҙ»вҖқзҡ„еҜ№з«Ӣе…ізі» пјҢ еӣ жӯӨжүҚжғіиҰҒжқҖжӯ»дәәзұ»пјҒ

йӮЈд№Ҳ пјҢ дәәе·ҘжҷәиғҪжңүдәҶиҮӘжҲ‘ж„ҸиҜҶ пјҢ е°ұдёҖе®ҡдјҡеҜ№дәәзұ»дә§з”ҹдёҚеҲ©еҪұе“Қеҗ—пјҹдәәзұ»дҪңдёәдәәе·ҘжҷәиғҪзҡ„еҲӣйҖ иҖ… пјҢ жҳҜеҗҰеҸҜд»ҘжҸҗеүҚйҒҝе…Қиҝҷз§Қжғ…еҶөеҸ‘з”ҹе‘ўпјҹ

иҰҒи§Јзӯ”иҝҷдёӘй—®йўҳ пјҢ жҲ‘们е°ұиҰҒд»ҺеӨ§еҗҚйјҺйјҺзҡ„вҖңжңәеҷЁдәәдёүе®ҡеҫӢвҖқиҜҙиө·дәҶ гҖӮ

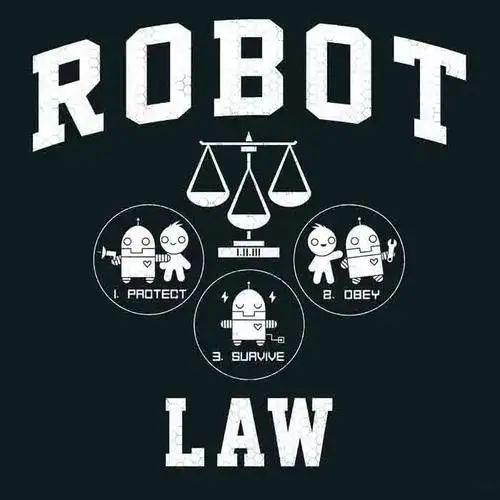

вҖңжңәеҷЁдәәдёүе®ҡеҫӢвҖқжҳҜз”ұ科幻дҪң家йҳҝиҘҝиҺ«еӨ«еңЁгҖҠжҲ‘ пјҢ жңәеҷЁдәәгҖӢиҝҷжң¬д№ҰйҮҢйҰ–ж¬ЎжҸҗеҮәзҡ„ пјҢ е…¶еҶ…е®№дёәпјҡ

第дёҖе®ҡеҫӢпјҡжңәеҷЁдәәдёҚеҫ—дјӨе®ідәәзұ»дёӘдҪ“ пјҢ жҲ–иҖ…зӣ®зқ№дәәзұ»дёӘдҪ“е°ҶйҒӯеҸ—еҚұйҷ©иҖҢиў–жүӢдёҚз®Ў гҖӮ

第дәҢе®ҡеҫӢпјҡжңәеҷЁдәәеҝ…йЎ»жңҚд»Һдәәз»ҷдәҲе®ғзҡ„е‘Ҫд»Ө пјҢ еҪ“иҜҘе‘Ҫд»ӨдёҺ第дёҖе®ҡеҫӢеҶІзӘҒж—¶дҫӢеӨ– гҖӮ

第дёүе®ҡеҫӢпјҡжңәеҷЁдәәеңЁдёҚиҝқеҸҚ第дёҖгҖҒ第дәҢе®ҡеҫӢзҡ„жғ…еҶөдёӢиҰҒе°ҪеҸҜиғҪдҝқжҠӨиҮӘе·ұзҡ„з”ҹеӯҳ гҖӮ

еҗҺжқҘйҳҝиҘҝиҺ«еӨ«еҸҲеңЁгҖҠжңәеҷЁдәәдёҺеёқеӣҪгҖӢдёҖд№Ұдёӯ пјҢ жҸҗеҮәдәҶеҮҢй©ҫдәҺвҖңжңәеҷЁдәәдёүе®ҡеҫӢвҖқд№ӢдёҠзҡ„вҖң第йӣ¶е®ҡеҫӢвҖқпјҡ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

жңәеҷЁдәәеҝ…йЎ»дҝқжҠӨдәәзұ»зҡ„ж•ҙдҪ“еҲ©зӣҠдёҚеҸ—дјӨе®іпјҲе…¶е®ғдёүжқЎе®ҡеҫӢйғҪжҳҜеңЁиҝҷдёҖеүҚжҸҗдёӢжүҚиғҪжҲҗз«Ӣпјү гҖӮ

然иҖҢ пјҢ вҖңжңәеҷЁдәәдёүе®ҡеҫӢвҖқе’ҢвҖң第йӣ¶е®ҡеҫӢвҖқ пјҢ зңҹзҡ„иғҪдҝқжҠӨдәәзұ»дёҚеҸ—дәәе·ҘжҷәиғҪеЁҒиғҒеҗ—пјҹ

йҰ–е…Ҳ пјҢ иҝҷеҮ жқЎе®ҡеҫӢжң¬иә«е°ұеҢ…еҗ«и®ёеӨҡж— жі•иҮӘжҙҪзҡ„BUG пјҢ дҫӢеҰӮвҖңдәәзұ»зҡ„ж•ҙ дҪ“еҲ©зӣҠвҖқ究з«ҹжҳҜе•Ҙпјҹиҝҷз§ҚжЁЎжЈұдёӨеҸҜзҡ„жҰӮеҝө пјҢ е°ұиҝһдәәзұ»иҮӘе·ұйғҪжҗһдёҚжҳҺзҷҪ пјҢ жӣҙдёҚеҝ…иҜҙйӮЈдәӣз”Ё0е’Ң1жқҘжғій—®йўҳзҡ„жңәеҷЁдәәдәҶ гҖӮ жӯЈеӣ еҰӮжӯӨ пјҢ еҸҰдёҖдҪҚи‘—еҗҚ科幻дҪң家еЁҒе°”В·еҸІеҜҶж–ҜжүҚдёҖй’Ҳи§ҒиЎҖең°иҜ„и®әиҜҙпјҡжңәеҷЁдәәжІЎжңүй—®йўҳ пјҢ 科жҠҖжң¬иә«д№ҹдёҚжҳҜй—®йўҳ пјҢ дәәзұ»йҖ»иҫ‘зҡ„жһҒйҷҗжүҚжҳҜзңҹжӯЈзҡ„й—®йўҳпјҒ

ж–Үз« жҸ’еӣҫ

ж–Үз« жҸ’еӣҫ

еҶҚиҖ… пјҢ еҪ“жңәеҷЁдәәйқўдёҙдёӨйҡҫйҖүжӢ©ж—¶ пјҢ е®ғзҡ„иҝҗз®—йҖ»иҫ‘е°ұдјҡеҸ—еҲ°е·ЁеӨ§зҡ„иҖғйӘҢ гҖӮ е°ұжӢҝйӮЈдёӘи‘—еҗҚзҡ„вҖңз”өиҪҰжӮ–и®әвҖқжқҘиҜҙеҗ§пјҡеҒҮеҰӮдёҖиҫҶз”өиҪҰжӯЈй©¶еҗ‘дёҖдёӘеІ”еҸЈ пјҢ 并еҮҶеӨҮе·ҰиҪ¬ гҖӮ е·Ұиҫ№еІ”и·ҜдёҠз»‘зқҖ 5 дёӘдәә пјҢ еҸіиҫ№еІ”и·ҜдёҠз»‘зқҖ 1 дёӘдәә пјҢ жӯӨж—¶ пјҢ з«ҷеңЁжҺ§еҲ¶еҸ°дёҠзҡ„жңәеҷЁдәә пјҢ иҜҘдёҚиҜҘжҺ§еҲ¶иҪ¬еҗ‘пјҹ

д№ҹе°ұжҳҜиҜҙ пјҢ еңЁйҖ»иҫ‘еұӮйқўдёҠ пјҢ дёҖдёӘйҒөе®ҲдёүеӨ§е®ҡеҫӢзҡ„жңәеҷЁдәә пјҢ иҝҹж—©дјҡйҒҮеҲ°дёҖдёӘеңЁж•°еӯҰжЁЎеһӢдёҠдёҺвҖңз”өиҪҰжӮ–и®әвҖқе®Ңе…Ёзӯүд»·зҡ„еӣ°еўғвҖ”вҖ”е®ғиҰҒд№Ҳж•‘ 5 дёӘдәәе®іжӯ» 1 дёӘдәә пјҢ иҰҒд№ҲдёәдәҶдёҚе®іжӯ» 1 дёӘдәәиҖҢйҖҡиҝҮдёҚдҪңдёәе®іжӯ»дәҶ 5 дёӘдәә гҖӮ

жҺЁиҚҗйҳ…иҜ»

- з»ҷдҪ зҡ„iPhone12е…Ёж–№дҪҚдҝқжҠӨпјҡ6ж¬ҫжүӢжңәдҝқжҠӨеЈіжЁӘиҜ„

- дёҚйҖҒе……з”өеҷЁиҖіжңәпјҢиӢ№жһңдёҖе№ҙиғҪзңҒ17дәҝпјҹеә“е…Ӣзҡ„е°Ҹз®—зӣҳжү“еҫ—зңҹеҘҪ

- 马ж–Ҝе…ӢеҲҡжҲҗе…ЁзҗғйҰ–еҜҢпјҢиЎҢдёҡеҸҲзҲҶйҮҚзЈ…ж–°й—»пјҒзҷҫеәҰиҰҒйҖ жұҪиҪҰдәҶпјҢеҗҲдҪңж–№жҳҜе®ғпјҒдј дёҺиӢ№жһңеҗҲдҪңйҖ иҪҰпјҢйҹ©еӣҪжұҪиҪҰе·ЁеӨҙиӮЎд»·жҡҙж¶Ё

- иҒ”еҸ‘科е®ҳе®Јж–°е“ҒеҸ‘еёғдјҡ1жңҲ20ж—ҘдёҫеҠһпјҒжҲ–жҳҜ6nmж–°иҠҜзүҮ

- SatechiжҺЁеҮәж–°ж¬ҫй“қеҲ¶иӢ№жһңй”®зӣҳдёҺiPadж”Ҝжһ¶й…Қ件

- з ”з©¶з§°iPhone 12еӣҪиЎҢ128GBзү©ж–ҷжҲҗжң¬жҸҗй«ҳдәҶ21%пјҡиӢ№жһңеҠ еҖҚиҪ¬е«Ғз»ҷж¶Ҳиҙ№иҖ…

- з”ЁжҲ·|е…ғж—ҰеҪ“еӨ©иӢ№жһңеә”з”Ёж¶Ҳиҙ№йўқи¶…иҝҮ5.4дәҝзҫҺе…ғ еҲ·ж–°еҚ•ж—Ҙж¶Ҳиҙ№и®°еҪ•

- иӢ№жһңеҲӣе§Ӣдәәд№”еёғж–Ҝзҡ„дј еҘҮдәәз”ҹпјҡйҖ е°ұдәҶиӢ№жһңзҡ„е·…еі°пјҢе…¶е®һжІЎйӮЈд№Ҳе®ҢзҫҺ

- дёҖеҲҷж¶ҲжҒҜдј жқҘпјҢиӢ№жһңiPhone12еҶҚзҺ°й—®йўҳпјҢвҖңжһңзІүвҖқжңүзӮ№ж…Ң

- иӢ№жһңдёӨж¬ҫж–°iPadйҪҗжӣқе…үпјҡжҖ§иғҪжҸҗй«ҳгҖҒе…Ҙй—Ёж¬ҫжӣҙиҪ»и–„гҖҒе”®д»·дҫҝе®ң